包阅导读总结

1. 关键词:Kubernetes、AI 推理、可扩展性、可移植性、容错机制

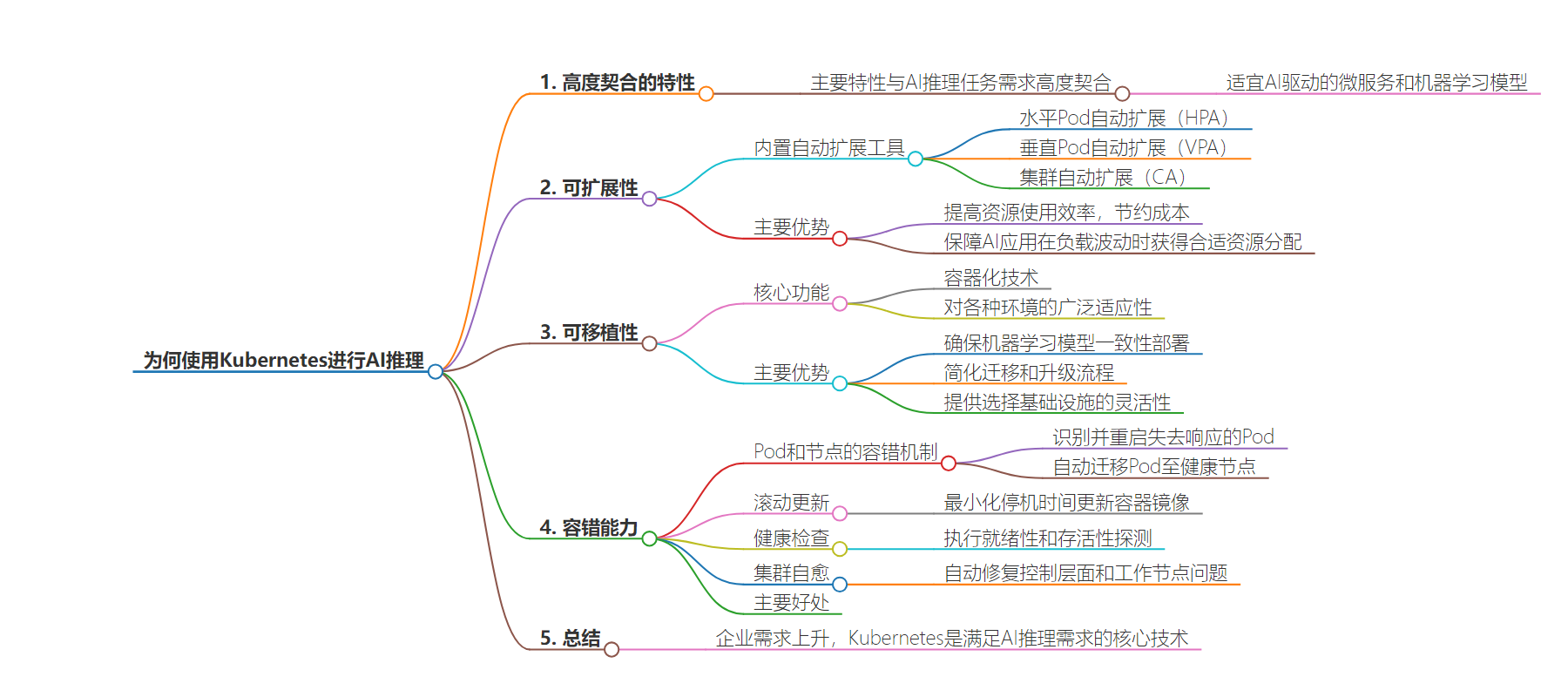

2. 总结:本文探讨了使用 Kubernetes 进行 AI 推理的原因,包括其核心功能与 AI 推理需求高度匹配,如提供可扩展性以优化资源使用和节约成本,实现可移植性便于部署,具备自愈和容错能力保障服务稳定,以满足企业大规模部署 AI 推理的需求。

3. 主要内容:

– Kubernetes 与 AI 推理的契合

– 特性与 AI 推理任务需求高度适配,适用于微服务和机器学习模型。

– 可扩展性优势

– 内置三种自动扩展工具:HPA、VPA、CA。

– 提高资源使用效率,节约成本,应对负载波动。

– 可移植性优势

– 容器化技术和广泛适应性实现。

– 确保一致部署,简化迁移和升级,提供基础设施选择灵活性。

– 容错机制

– Pod 和节点容错,滚动更新,健康检查,集群自愈。

– 避免故障导致的问题,保障服务连续性和可用性。

– 结论

– 企业大规模部署 AI 推理时,Kubernetes 作为核心技术需求上升,因其内置所需功能。

思维导图:

文章地址:https://mp.weixin.qq.com/s/5iarij6Z_AHB935vmXcMjQ

文章来源:mp.weixin.qq.com

作者:Zulyar??Ilakhunov

发布时间:2024/8/13 9:28

语言:中文

总字数:2786字

预计阅读时间:12分钟

评分:85分

标签:AI推理,Kubernetes,可扩展性,资源优化,性能优化

以下为原文内容

本内容来源于用户推荐转载,旨在分享知识与观点,如有侵权请联系删除 联系邮箱 media@ilingban.com

原文标题:5 Reasons To Use Kubernetes for AI Inference

Kubernetes成为AI推理领域的首选,归功于其与AI推理需求高度匹配的多项核心功能。

Kubernetes的主要特性与AI推理任务的需求高度契合,无论是AI驱动的微服务还是机器学习模型,这些功能都显得格外适宜。让我们深入了解这些特性,以及它们如何为AI推理工作负载带来益处。

AI应用程序和机器学习(ML)模型的扩展能力保证了它们可以应对所需的工作量,例如同时发生的用户请求。Kubernetes提供了三种内置的自动扩展工具,每个工具都有助于提升系统的可扩展性:水平Pod自动扩展(HPA)、垂直Pod自动扩展(VPA)以及集群自动扩展(CA)。

以下是Kubernetes的可扩展性为AI推理带来的主要优势:

通过全面提高推理工作负载的资源使用效率,确保为这些工作负载分配恰当的资源量。这种做法有助于成本节约,尤其是在使用成本较高的GPU时显得尤为重要。Kubernetes的关键功能,包括高效的资源配置、对资源限制和请求的精细管理,以及自动扩展,使得资源使用的优化成为可能。

利用Kubernetes的这些特性,工作负载能够获得恰到好处的计算资源。考虑到在云平台上租赁中等性能GPU的费用大约为每小时1到2美元,所以在一定程度上可以带来显著的成本节约。

尽管AI推理在资源需求上通常低于训练过程,但它仍旧依赖于GPU和其他计算资源以保持高效。Kubernetes的HPA、VPA和CA是提升推理效率的关键因素,它们保障了AI应用即便在负载波动时也能得到合适的资源分配。此外,可以利用如StormForge或Magalix Agent这类工具来进一步管理和预测AI工作负载的性能。

总而言之,Kubernetes的灵活性和资源使用优化功能,确保了AI应用无论规模大小或负载变化,都能达到最佳运行状态。

对于AI工作负载,如机器学习模型,可移植性极为重要。这样就可以在各种环境用同一方式部署,无需顾虑底层基础设施的差异,进而节约时间和成本。Kubernetes主要通过两个核心功能来实现这种可移植性:容器化技术以及对各种环境的广泛适应性。

以下是Kubernetes在可移植性方面的主要优势:

-

确保机器学习模型在多样化的环境下实现一致性部署。

-

简化了AI工作负载的迁移和升级流程。

-

提供了在选择云服务商或本地基础设施时的灵活性。

执行AI推理任务时,基础设施的故障或中断可能导致精度显著降低、模型行为变得不稳定或服务完全停止。这种情况对于多数AI应用来说是不可容忍的,尤其是对于那些安全性至关重要的应用,如机器人技术、无人驾驶汽车和医疗诊断。Kubernetes的自愈能力和容错机制有助于避免这些问题的发生。

-

Pod和节点的容错机制:Kubernetes能够识别并自动重启失去响应的Pod,保障应用的持续可用性和响应性。若Pod所在的节点发生故障,Kubernetes将自动将Pod迁移至健康的节点。

-

滚动更新:Kubernetes允许进行滚动更新,允许在最小化停机时间的情况下更新容器镜像。这样就可以迅速实施错误修正或模型更新,同时确保推理服务的连续性。

-

健康检查:通过就绪性和存活性探测,Kubernetes执行健康检查,以确定容器是否能够接收流量或是否处于健康状态,并在需要时触发容器的重启或替换。

-

集群自愈:Kubernetes具备自动修复功能,能够处理控制层面和工作节点的问题,比如替换故障节点或重启异常组件,从而保持AI推理集群的健康和可用性。

以下是Kubernetes容错功能的主要好处:

随着企业不断将人工智能集成到它们的应用之中,部署大规模机器学习模型并应对变化的负载,选择Kubernetes作为核心技术变得非常关键。作为Kubernetes的托管服务提供者,我们观察到市场对具备可扩展性、容错能力和成本效益的基础设施的需求日益上升,这样的基础设施能够满足AI推理的需求。Kubernetes正是一个内建这些功能的平台。