包阅导读总结

1. 关键词:谷歌、Gemma 2 2B、小模型、性能优越、安全分类

2. 总结:

谷歌开源端侧小模型 Gemma 2 2B,参数仅 20 亿却胜过 GPT-3.5-Turbo 等。该模型性能与效率平衡,还有安全分类器 ShieldGemma 和模型解释工具 Gemma Scope。其展示小模型的优势,挑战了“模型越大越好”的观念。

3. 主要内容:

– 谷歌开源 Gemma 2 系列模型

– 6 月底开源 9B、27B 版,27B 版在 LMSYS Chatbot Arena 表现出色

– 一个多月后新增更轻量级 Gemma 2 2B 版本,还有 ShieldGemma 和 Gemma Scope

– Gemma 2 2B 模型

– 性能优越,在 LMSYS Chatbot Arena 中得分高于 GPT-3.5-Turbo 等

– 在 iPhone 15 pro 上运行速度快,能处理难题

– 由先进硬件训练而成,适合设备应用

– 具有卓越性能、部署灵活且经济高效、开源且易于访问等优点

– ShieldGemma

– 先进的安全分类器,检测和缓解有害内容

– 达到行业领先水平,提供多种型号满足不同需求

– Gemma Scope

– 帮助探索构建更可靠的 AI 系统

– 用稀疏自编码器提供透明度,有开创性

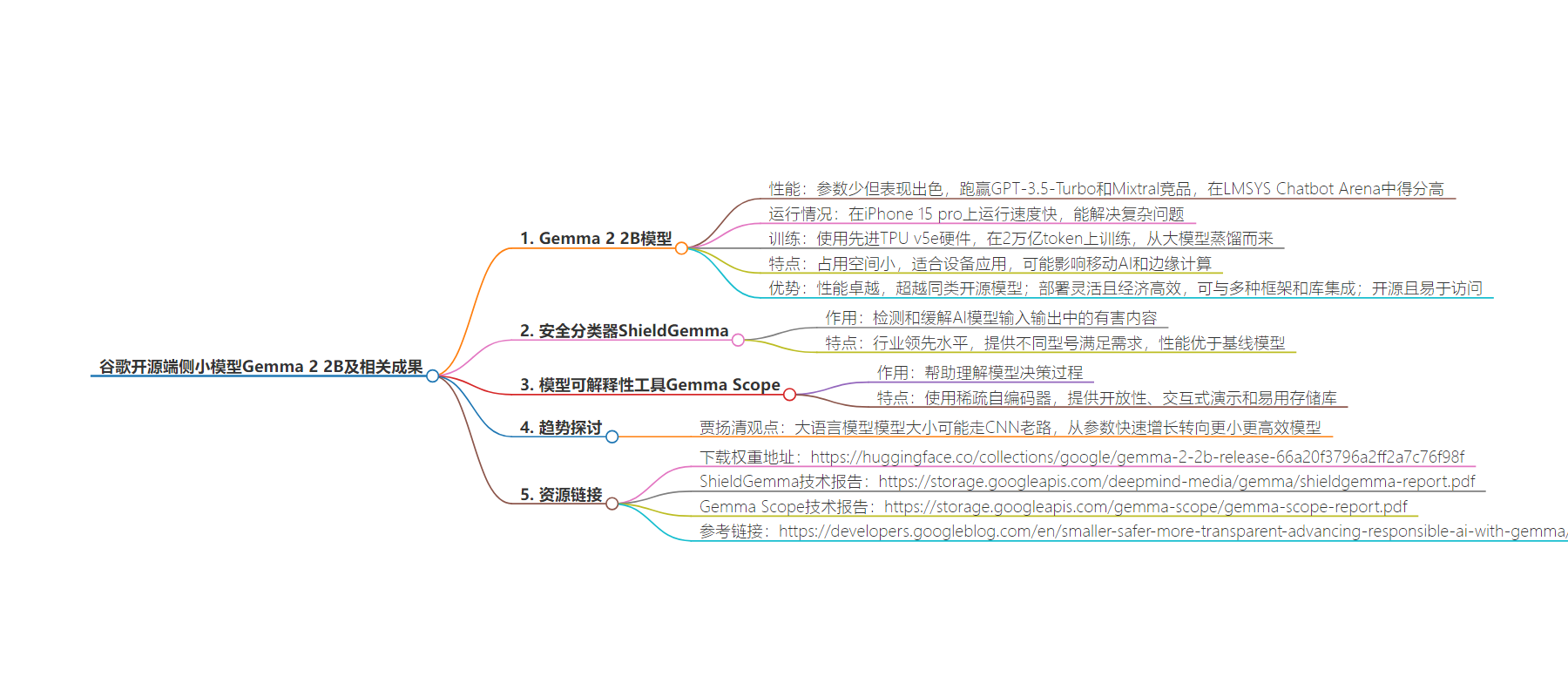

思维导图:

文章地址:https://www.jiqizhixin.com/articles/2024-08-01-7

文章来源:jiqizhixin.com

作者:机器之心

发布时间:2024/8/1 7:18

语言:中文

总字数:2897字

预计阅读时间:12分钟

评分:92分

标签:小模型,AI模型,谷歌,开源,模型安全

以下为原文内容

本内容来源于用户推荐转载,旨在分享知识与观点,如有侵权请联系删除 联系邮箱 media@ilingban.com

谷歌也来卷「小」模型了,一出手就是王炸,胜过了比自己参数多得多的GPT-3.5、Mixtral竞品模型。

今年 6 月底,谷歌开源了 9B、27B 版 Gemma 2 模型系列,并且自亮相以来,27B 版本迅速成为了大模型竞技场 LMSYS Chatbot Arena 中排名最高的开放模型之一,在真实对话任务中比其两倍规模以上的模型表现还要好。

如今,仅仅过去了一个多月,谷歌在追求负责任 AI 的基础上,更加地考虑该系列模型的安全性和可访问性,并有了一系列新成果。

此次,Gemma 2 不仅有了更轻量级「Gemma 2 2B」版本,还构建一个安全内容分类器模型「ShieldGemma」和一个模型可解释性工具「Gemma Scope」。具体如下:

-

Gemma 2 2B 具有内置安全改进功能,实现了性能与效率的强大平衡;

-

ShieldGemma 基于 Gemma 2 构建,用于过滤 AI 模型的输入和输出,确保用户安全;

-

Gemma Scope 提供对模型内部工作原理的无与伦比的洞察力。

其中,Gemma 2 2B 无疑是「最耀眼的仔」,它在大模型竞技场 LMSYS Chatbot Arena 中的结果令人眼前一亮:仅凭 20 亿参数就跑出了 1130 分,这一数值要高于 GPT-3.5-Turbo(0613)和 Mixtral-8x7b。

这也意味着,Gemma 2 2B 将成为端侧模型的最佳选择。

苹果机器学习研究(MLR)团队研究科学家 Awni Hannun 展示了 Gemma 2 2B 跑在 iPhone 15 pro 上的情况,使用了 4bit 量化版本,结果显示速度是相当快。

视频来源:https://x.com/awnihannun/status/1818709510485389563

此外,对于前段时间很多大模型都翻了车的「9.9 和 9.11 谁大」的问题,Gemma 2 2B 也能轻松拿捏。

图源:https://x.com/tuturetom/status/1818823253634564134

与此同时,从谷歌 Gemma 2 2B 的强大性能也可以看到一种趋势,即「小」模型逐渐拥有了与更大尺寸模型匹敌的底气和效能优势。

这种趋势也引起了一些业内人士的关注,比如知名人工智能科学家、Lepton AI 创始人贾扬清提出了一种观点:大语言模型(LLM)的模型大小是否正在走 CNN 的老路呢?

在 ImageNet 时代,我们看到参数大小快速增长,然后我们转向了更小、更高效的模型。这是在 LLM 时代之前,我们中的许多人可能已经忘记了。

-

大型模型的曙光:我们以 AlexNet(2012)作为基线开始,然后经历了大约 3 年的模型大小增长。VGGNet(2014)在性能和尺寸方面都可称为强大的模型。

-

缩小模型:GoogLeNet(2015)将模型大小从 GB 级缩小到 MB 级,缩小了 100 倍,同时保持了良好的性能。类似工作如 SqueezeNet(2015)和其他工作也遵循类似的趋势。

-

合理的平衡:后来的工作如 ResNet(2015)、ResNeXT(2016)等,都保持了适中的模型大小。请注意,我们实际上很乐意使用更多的算力,但参数高效同样重要。

-

设备端学习?MobileNet(2017)是谷歌的一项特别有趣的工作,占用空间很小,但性能却非常出色。上周,我的一个朋友告诉我「哇,我们仍然在使用 MobileNet,因为它在设备端具有出色的特征嵌入通用性」。是的,嵌入式嵌入是实实在在很好用。

最后,贾扬清发出灵魂一问,「LLM 会遵循同样的趋势吗?」

图像出自 Ghimire 等人论文《A Survey on Efficient Convolutional Neural Networks and Hardware Acceleration》。

Gemma 2 2B 越级超越 GPT-3.5 Turbo

Gemma 2 家族新增 Gemma 2 2B 模型,备受大家期待。谷歌使用先进的 TPU v5e 硬件在庞大的 2 万亿个 token 上训练而成。

这个轻量级模型是从更大的模型中蒸馏而来,产生了非常好的结果。由于其占用空间小,特别适合设备应用程序,可能会对移动 AI 和边缘计算产生重大影响。

事实上,谷歌的 Gemma 2 2B 模型在 Chatbot Arena Elo Score 排名中胜过大型 AI 聊天机器人,展示了小型、更高效的语言模型的潜力。下图表显示了 Gemma 2 2B 与 GPT-3.5 和 Llama 2 等知名模型相比的卓越性能,挑战了「模型越大越好」的观念。

Gemma 2 2B 提供了:

-

性能卓越:在同等规模下提供同类最佳性能,超越同类其他开源模型;

-

部署灵活且经济高效:可在各种硬件上高效运行,从边缘设备和笔记本电脑到使用云部署如 Vertex AI 和 Google Kubernetes Engine (GKE) 。为了进一步提高速度,该模型使用了 NVIDIA TensorRT-LLM 库进行优化,并可作为 NVIDIA NIM 使用。此外,Gemma 2 2B 可与 Keras、JAX、Hugging Face、NVIDIA NeMo、Ollama、Gemma.cpp 以及即将推出的 MediaPipe 无缝集成,以简化开发;

-

开源且易于访问:可用于研究和商业应用,由于它足够小,甚至可以在 Google Colab 的 T4 GPU 免费层上运行,使实验和开发比以往更加简单。

从今天开始,用户可以从 Kaggle、Hugging Face、Vertex AI Model Garden 下载模型权重。用户还可以在 Google AI Studio 中试用其功能。

下载权重地址:https://huggingface.co/collections/google/gemma-2-2b-release-66a20f3796a2ff2a7c76f98f

Gemma 2 2B 的出现挑战了人工智能开发领域的主流观点,即模型越大,性能自然就越好。Gemma 2 2B 的成功表明,复杂的训练技术、高效的架构和高质量的数据集可以弥补原始参数数量的不足。这一突破可能对该领域产生深远的影响,有可能将焦点从争夺越来越大的模型转移到改进更小、更高效的模型。

Gemma 2 2B 的开发也凸显了模型压缩和蒸馏技术日益增长的重要性。通过有效地将较大模型中的知识提炼成较小的模型,研究人员可以在不牺牲性能的情况下创建更易于访问的 AI 工具。这种方法不仅降低了计算要求,还解决了训练和运行大型 AI 模型对环境影响的担忧。

ShieldGemma:最先进的安全分类器

技术报告:https://storage.googleapis.com/deepmind-media/gemma/shieldgemma-report.pdf

ShieldGemma 是一套先进的安全分类器,旨在检测和缓解 AI 模型输入和输出中的有害内容,帮助开发者负责任地部署模型。

ShieldGemma 专门针对四个关键危害领域进行设计:

这些开放分类器是对负责任 AI 工具包(Responsible AI Toolkit)中现有安全分类器套件的补充。

借助 ShieldGemma,用户可以创建更加安全、更好的 AI 应用

SOTA 性能:作为安全分类器,ShieldGemma 已经达到行业领先水平;

规模不同:ShieldGemma 提供各种型号以满足不同的需求。2B 模型非常适合在线分类任务,而 9B 和 27B 版本则为不太关心延迟的离线应用程序提供了更高的性能。

如下表所示,ShieldGemma (SG) 模型(2B、9B 和 27B)的表现均优于所有基线模型,包括 GPT-4。

Gemma Scope:让模型更加透明

Gemma Scope 旨在帮助 AI 研究界探索如何构建更易于理解、更可靠的 AI 系统。其为研究人员和开发人员提供了前所未有的透明度,让他们能够了解 Gemma 2 模型的决策过程。Gemma Scope 就像一台强大的显微镜,它使用稀疏自编码器 (SAE) 放大模型的内部工作原理,使其更易于解释。

Gemma Scope 技术报告:https://storage.googleapis.com/gemma-scope/gemma-scope-report.pdf

SAE 可以帮助用户解析 Gemma 2 处理的那些复杂信息,将其扩展为更易于分析和理解的形式,因而研究人员可以获得有关 Gemma 2 如何识别模式、处理信息并最终做出预测的宝贵见解。

以下是 Gemma Scope 具有开创性的原因:

-

开放的 SAE:超过 400 个免费 SAE,涵盖 Gemma 2 2B 和 9B 的所有层;

-

交互式演示:无需在 Neuronpedia 上编写代码即可探索 SAE 功能并分析模型行为;

-

易于使用的存储库:提供了 SAE 和 Gemma 2 交互的代码和示例。

参考链接:

https://developers.googleblog.com/en/smaller-safer-more-transparent-advancing-responsible-ai-with-gemma/