包阅导读总结

1. 关键词:

– 大模型、技术细节、优化器、数据交易、RISC-V

2. 总结:

本文涵盖了对大模型的看法、多种技术架构和研究成果,包括不看好 LLM 的观点、Hopper 架构特性、机器人设计避坑、优化 PyTorch 优化器、贵阳大数据战役评价、RISC-V 产业年鉴等内容。

3. 主要内容:

– 大模型相关

– 有人通过实习经历对 LLM 提出批判性看法,强调其局限性和人类干预的重要性。

– 技术架构与研究

– Hopper 架构通过新技术提升 GPU 性能。

– 介绍机器人工作空间的概念及应用中的问题。

– 阐述 CUDA-MODE 课程中优化 PyTorch 优化器的方法。

– 分享 Ring Attention + Flash Attention 前向推导细节。

– 提出在基于变换器的视频扩散模型中控制 3D 相机角度的新方法。

– 产业与应用

– 对贵阳大数据战役进行评价,分析数据交易所面临的问题。

– 发布《RISC-V 产业年鉴 2023》,强调产业发展要点。

– 介绍 mathstral-7B-v0.1 模型在数学和科学任务中的表现及使用方式。

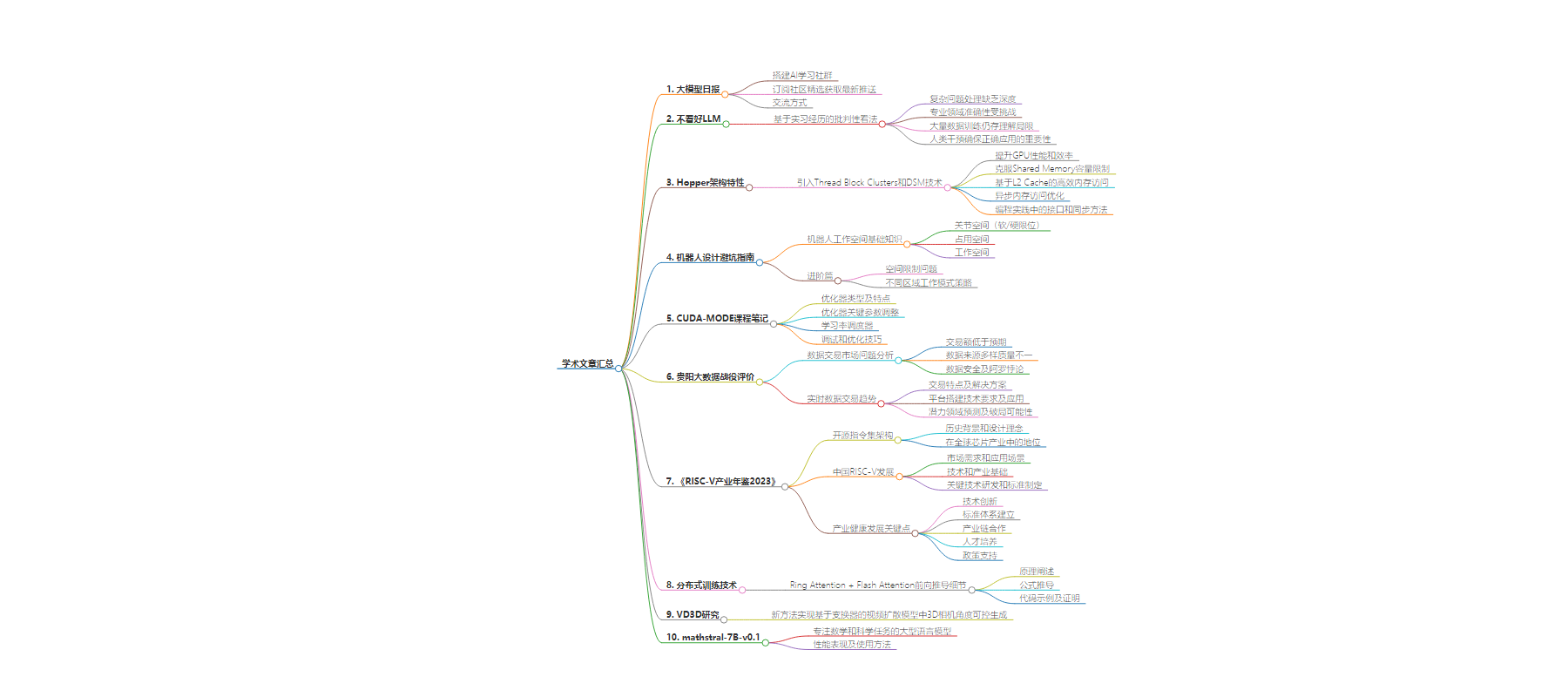

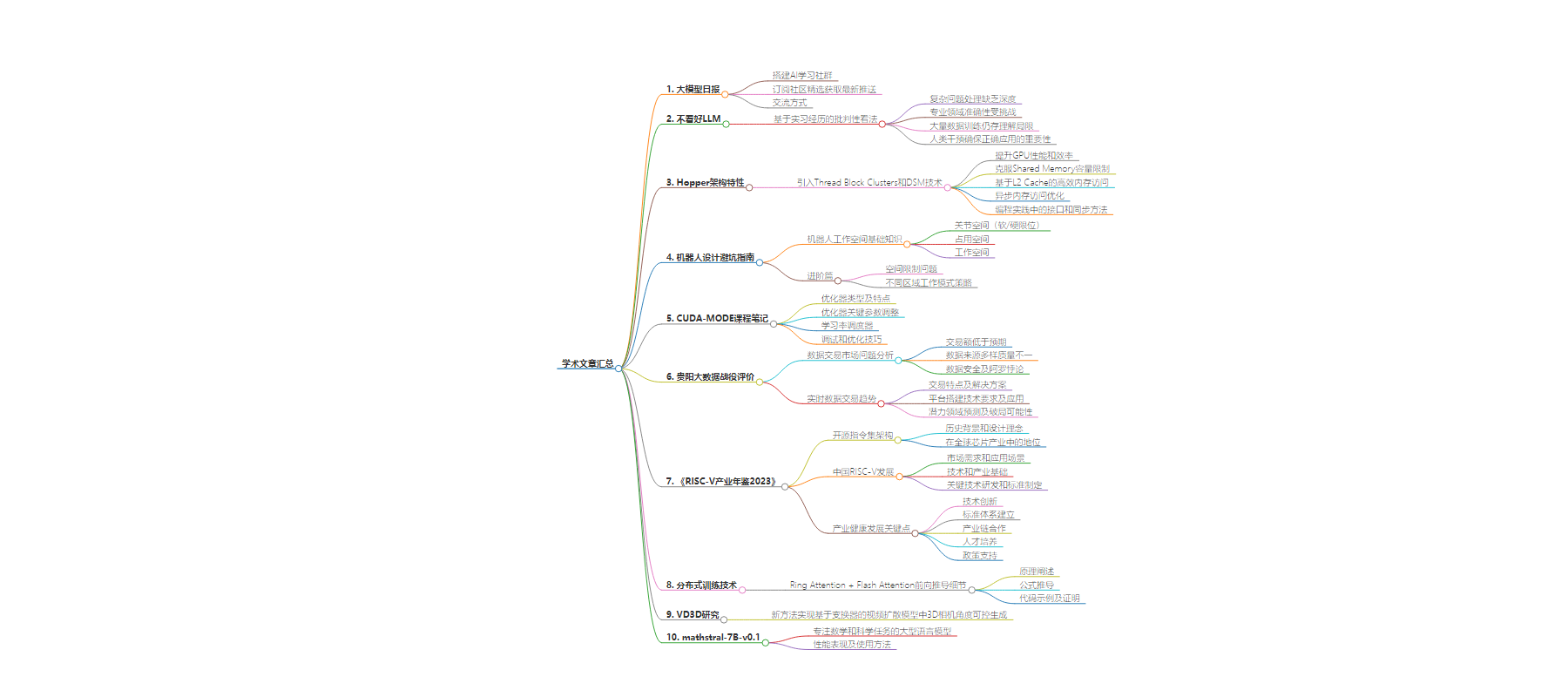

思维导图:

文章地址:https://mp.weixin.qq.com/s/R-_4HFHvLIu-dKmrzQh_-w

文章来源:mp.weixin.qq.com

作者:LLM??SPACE

发布时间:2024/7/19 12:54

语言:中文

总字数:3126字

预计阅读时间:13分钟

评分:80分

标签:大型语言模型,GPU架构,机器人设计,PyTorch优化,大数据交易

以下为原文内容

本内容来源于用户推荐转载,旨在分享知识与观点,如有侵权请联系删除 联系邮箱 media@ilingban.com

我们希望能够搭建一个AI学习社群,让大家能够学习到最前沿的知识,大家共建一个更好的社区生态。

https://www.feishu.cn/community/article/wiki?id=7355065047338450972

点击「订阅社区精选」,即可在飞书每日收到《大模型日报》每日最新推送

如果想和我们空间站日报读者和创作团队有更多交流,欢迎扫码。

欢迎大家一起交流!

学习

我为什么不看好LLM —— 记过去一年实习经历有感

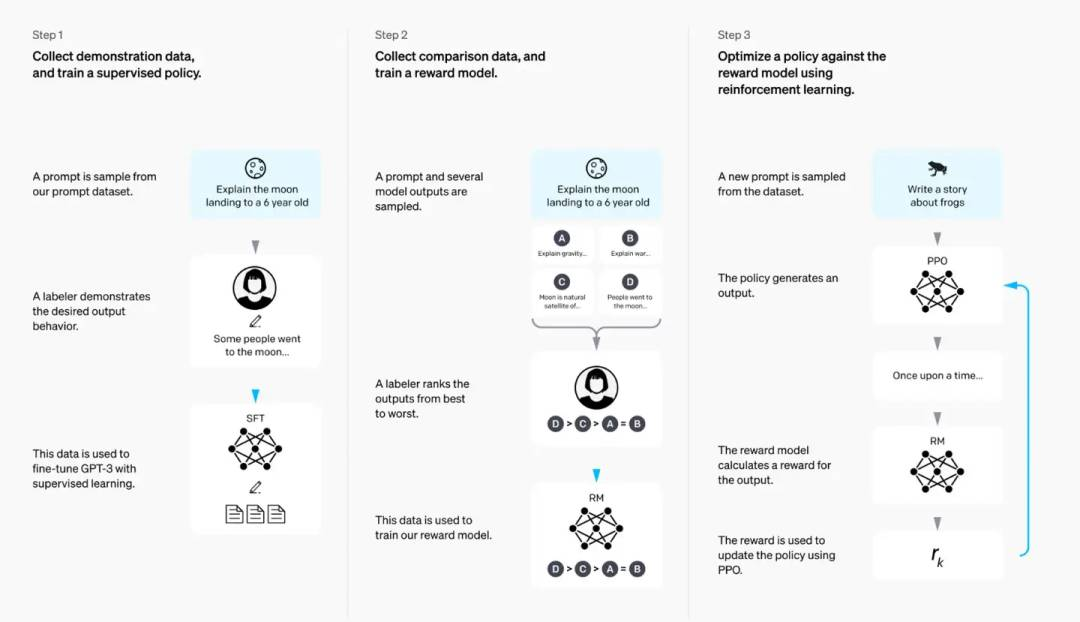

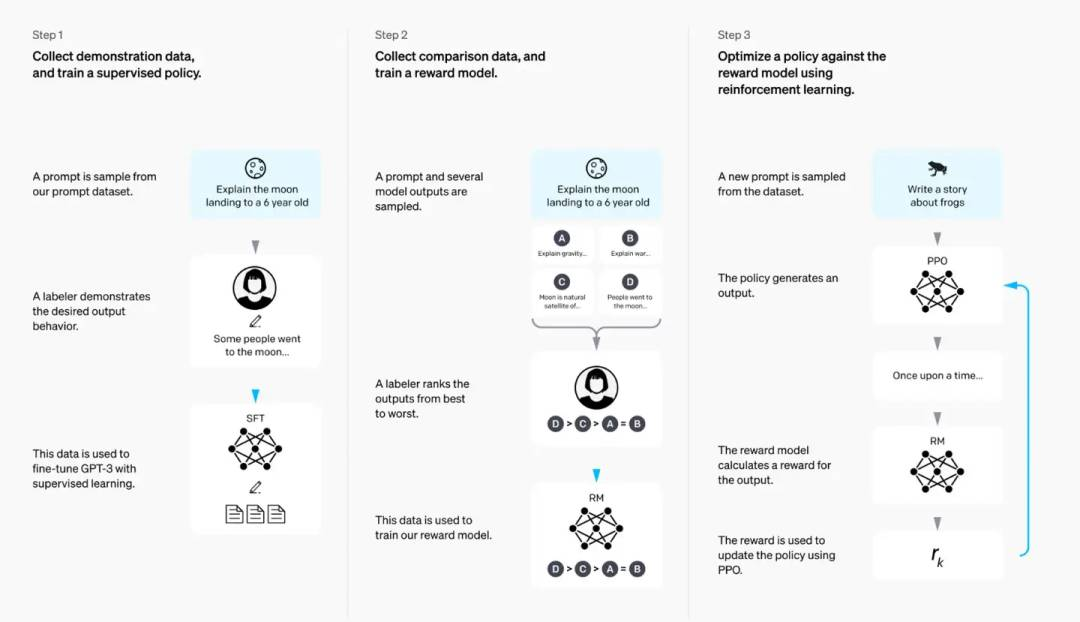

文章作者通过一年的实习经历,对大型语言模型(LLM)如 GPT-3 的实际应用提出了批判性看法。作者指出 LLM 虽在某些任务上表现出色,但在技术细节上存在显著问题。LLM 对于复杂问题的处理往往缺乏深度,尤其在专业领域如法律和医疗,其准确性受到挑战。此外,LLM 需要大量数据训练,却仍难以完全理解文化背景和歧义,可能导致误导性输出。作者强调,人类的直觉和创造力在问题解决中不可替代,强调在使用 LLM 时需要人类的判断和监督来确保技术的正确应用。总结中强调的技术细节包括 LLM 在处理专业知识、理解语言歧义和文化差异方面的局限性,以及人类干预对于提高技术可靠性的重要性。

https://zhuanlan.zhihu.com/p/709590163?utm_psn=1797587296884772864

https://zhuanlan.zhihu.com/p/709590163?utm_psn=1797587296884772864

[Hopper 架构特性学习笔记 Part1] Distributed Shared Memory

Hopper 架构通过引入 Thread Block Clusters 和 Distributed Shared Memory(DSM)技术,提升了 GPU 在处理大规模并行任务时的性能和效率。DSM 允许多个 Thread Block 跨越不同的 SM 共享内存,从而克服了单个 Thread Block 因 Shared Memory 容量限制而无法处理大规模数据的问题。Hopper 架构中的 DSM 实现了基于 L2 Cache 的高效内存访问,尽管访问延迟高于 Shared Memory,但远低于 Global Memory。同时,Hopper 提供了 TMA 单元支持异步内存访问,进一步优化了内存计算的效率。在编程实践中,CUDA 的 Cooperative Groups 模块为开发者提供了访问和同步 DSM 的接口,如 cg::this_cluster() 和 cluster.sync(),以及优化同步的 cluster.barrier_arrive() 和 cluster.barrier_wait()。这些技术细节的深入理解和恰当应用,能够帮助开发者充分发挥 Hopper 架构的潜力,实现高效的多 Thread Block 协同运行和性能优化。

https://zhuanlan.zhihu.com/p/708645371?utm_psn=1797581865554698240

https://zhuanlan.zhihu.com/p/708645371?utm_psn=1797581865554698240

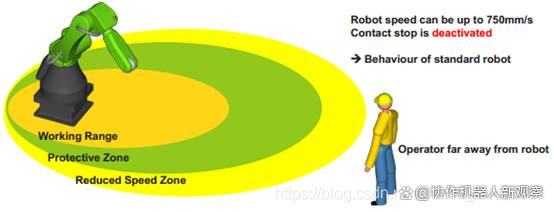

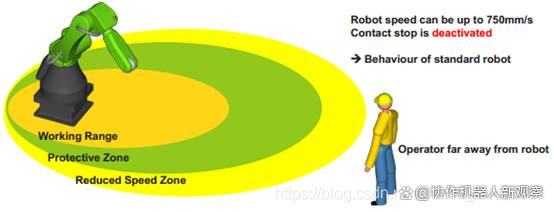

机器人设计避坑指南47——复杂的机器人工作空间

文章首先介绍了机器人工作空间的基础知识,包括关节空间(软限位)、关节空间(硬限位)、占用空间和工作空间等概念。作者指出,尽管这些概念看似基础,但在实际应用中往往因为对这些概念理解不够深入而导致问题。文章通过 EPSON 的 SCARA 机器人为例,说明了关节空间的软限位和硬限位的区别,以及如何根据关节角度限制来绘制关节空间。接着,文章介绍了占用空间的概念,即在关节空间中考虑机器人末端和夹具实际占用的空间。然后,文章深入探讨了工作空间的概念,指出工作空间可能小于关节空间,并且可能因为机器人结构限制而导致某些区域无法使用。文章以 DELTA 机器人和六关节机器人为例,说明了工作空间的限制和推荐工作空间的重要性。

在进阶篇中,文章讨论了 “空间” 限制的问题,包括如何让机器人避开特定空间,以及如何通过控制系统实时监测机器人位置来确保安全。作者提到了干涉区、安全区等高级功能,并解释了人机交互或双机协同时的空间限制策略。文章还提到了动态干涉区的概念,以及如何根据夹具的形状来表示占用空间。最后,文章探讨了不同区域采用不同工作模式的策略,例如 FANUC 和 ABB 机器人的安全策略,以及如何在协作区和非协作区之间切换工作模式。

https://zhuanlan.zhihu.com/p/702406630?utm_psn=1797588523722866689

https://zhuanlan.zhihu.com/p/702406630?utm_psn=1797588523722866689

CUDA-MODE课程笔记 第6课: 如何优化PyTorch中的优化器

文章首先介绍了不同类型的优化器,如 SGD、Adam、RMSprop 等,并分别讨论了它们的特点和适用场景。接着,详细阐述了优化器中的几个关键参数,包括学习率、动量、权重衰减等,以及如何根据具体问题调整这些参数以提高训练效率。文章还提到了使用学习率调度器来动态调整学习率的重要性,并举例说明了如何在实际代码中实现。此外,作者还分享了一些实用的调试和优化技巧,例如使用混合精度训练、分布式训练以及如何通过钩子函数来监控训练过程中的参数变化。最后,文章强调了在实际应用中选择和调整优化器的重要性,以及如何结合实验和理论知识来进行有效的优化器选择和调整。

https://zhuanlan.zhihu.com/p/709594587?utm_psn=1797588664215285760

https://zhuanlan.zhihu.com/p/709594587?utm_psn=1797588664215285760

如何评价贵阳轰轰烈烈的大数据战役?

作者 Jeff Tao 在参加中国计算机学会数据库战略研讨会后,对数据资产的确权、定价、流通、安全、供需匹配等问题进行了深入思考。他指出,尽管数据已成为第五大生产要素,但贵阳大数据交易所的实际交易额远低于预期目标,反映出数据交易市场的热度与实际交易活跃度之间存在鸿沟。作者分析了数据交易所面临的问题,包括数据来源的多样性、质量不一、数据安全问题、以及 “阿罗悖论” 导致的数据复制成本低下等。针对这些问题,作者提出了实时数据交易作为一种趋势,并强调了实时数据的交易特点,如时间敏感性、延时对价值的影响、以及数据复制问题的解决方案。作者还提到了实时数据交易平台的搭建技术要求、以及 TDengine 作为时序数据处理平台在实时数据交易中的应用。最后,作者预测了公用事业数据、电商交易数据、物联网设备数据等领域的实时数据交易的潜力,并对实时数据交易所破局的可能性表示乐观态度。

https://www.zhihu.com/question/29880671/answer/3566097571?utm_psn=1797588246345154561

《RISC-V产业年鉴2023》发布,洞察产业发展现状与趋势

《RISC-V 产业年鉴 2023》深入浅出地阐述了 RISC-V 开源指令集架构的历史背景、设计理念及其在全球芯片产业中的地位。报告指出,尽管 RISC-V 生态仍处于初级阶段,但其开放性和灵活性为中国等国家提供了进入全球产业链的独特机遇。中国不仅拥有庞大的市场需求和丰富的应用场景,而且在 RISC-V 技术和产业基础上也已有一定的积累。中国企业正积极参与 RISC-V 的关键技术研发和标准制定,显著提升了在全球 RISC-V 发展中的影响力。

为确保 RISC-V 产业的健康可持续发展,报告强调了以下几个关键点:首先,加强技术创新,开发出性能优异、功耗低、安全可靠的芯片产品;其次,建立完善的 RISC-V 标准体系,推动生态系统的健康发展;第三,强化产业链上下游的合作,避免不必要的竞争,共同促进 RISC-V 产业的成长;第四,加强 RISC-V 人才的培养,为产业发展提供人才保障;最后,政府需要出台更多支持 RISC-V 产业发展的政策,营造良好的市场环境。

【分布式训练技术分享十五】聊聊Ring Attention + Flash Attention前向推导细节

文章首先介绍了大型语言模型(LLM)在序列长度方面的扩展,提到了 Megatron-LM 使用的 Ring Attention + Flash Attention 技术。接着,详细阐述了 Ring Attention 的原理,即将 QKV 矩阵在 sequence 维度切分,并通过环形通信进行计算。与 Colossal-AI 的序列并行不同,Ring Attention 通过一次通信计算 softmax,需要对 Flash Attention 的实现进行修正。文章进一步推导了 Ring Attention 的公式,并解释了如何通过分块计算和修正操作来得到正确的 self-attention 结果。在此基础上,文章深入探讨了 Ring Attention 与 Flash Attention 结合时的公式推导,包括如何处理 softmax 函数的数值稳定性问题,以及如何利用 log-sum-exp(LSE)函数来简化计算过程。最后,文章展示了在 transformer_engine 中实现 Ring Attention + Flash Attention 的代码示例,并对实现 1 和实现 2 进行了数学证明,确保它们是等价的。

https://zhuanlan.zhihu.com/p/709402194?utm_psn=1797279605201186818

https://zhuanlan.zhihu.com/p/709402194?utm_psn=1797279605201186818

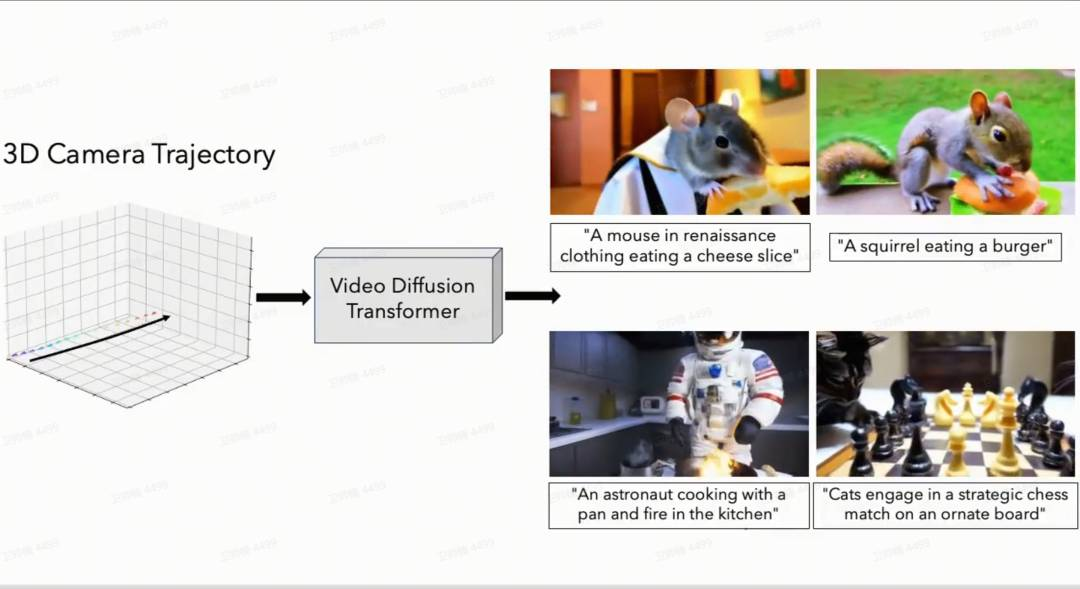

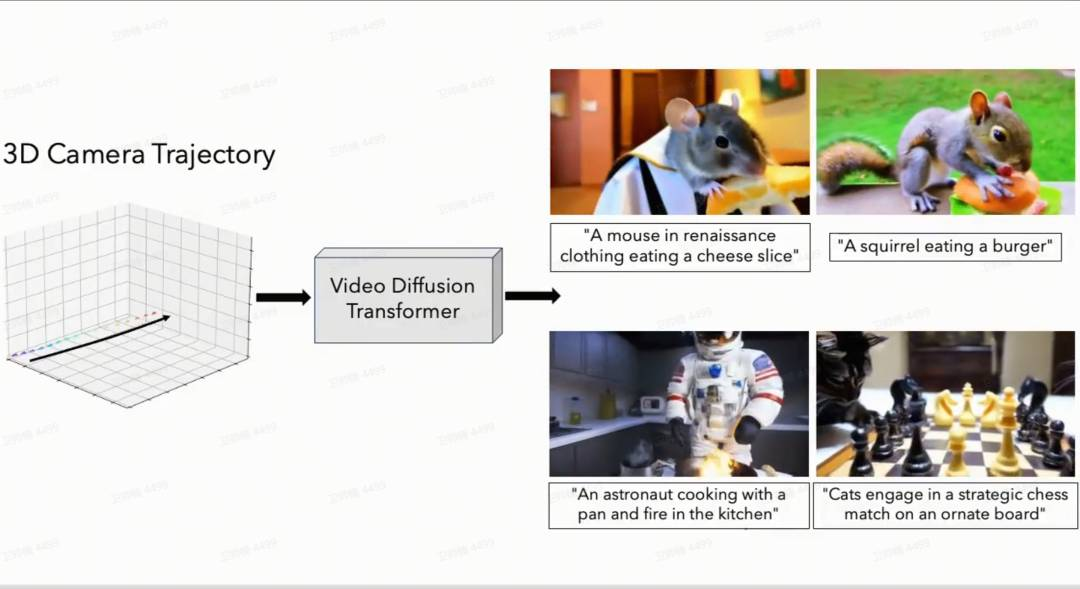

VD3D

这项研究提出了一种新方法,可以在基于变换器的视频扩散模型中引入对 3D 相机角度的可控生成能力。现有的视频合成模型大多缺乏对相机运动的细粒度控制,这限制了它们在内容创作、视觉特效等应用中的使用。

最近有一些方法展示了生成可控相机姿态视频的能力,但它们都是基于预训练的 U-Net 扩散模型。这项新研究则针对新兴的基于变换器的视频扩散模型,提出了一种利用 ControlNet 机制的方法,将时空相机嵌入纳入模型,从而实现对视频相机角度的可控生成。

团队认为这是首次在变换器视频扩散模型上实现对相机角度的可控生成,在提高视频合成的可控性和应用性方面具有重要意义。

https://snap-research.github.io/vd3d/

https://snap-research.github.io/vd3d/

mathstral-7B-v0.1

mathstral-7b 是一个专注于数学和科学任务的大型语言模型,基于 Mistral 7B 模型开发。它在多个数学和科学基准测试中表现优于同类大型语言模型。该模型可以通过 mistral_inference 库进行安装和使用,也可以在 transformers 库中进行调用。

https://huggingface.co/mistralai/mathstral-7B-v0.1

-

-

-

— END —

https://zhuanlan.zhihu.com/p/709590163?utm_psn=1797587296884772864

https://zhuanlan.zhihu.com/p/709590163?utm_psn=1797587296884772864 https://zhuanlan.zhihu.com/p/708645371?utm_psn=1797581865554698240

https://zhuanlan.zhihu.com/p/708645371?utm_psn=1797581865554698240 https://zhuanlan.zhihu.com/p/702406630?utm_psn=1797588523722866689

https://zhuanlan.zhihu.com/p/702406630?utm_psn=1797588523722866689 https://zhuanlan.zhihu.com/p/709594587?utm_psn=1797588664215285760

https://zhuanlan.zhihu.com/p/709594587?utm_psn=1797588664215285760 https://zhuanlan.zhihu.com/p/709402194?utm_psn=1797279605201186818

https://zhuanlan.zhihu.com/p/709402194?utm_psn=1797279605201186818 https://snap-research.github.io/vd3d/

https://snap-research.github.io/vd3d/