包阅导读总结

1. 关键词:OpenAI、数学题、Prover-Verifier Games、AI 输出、迭代

2. 总结:OpenAI 发布论文研究小学数学题解法,旨在解决 AI 在数学等常识问题上表现不佳的情况,提出 Prover-Verifier Games 框架,通过证明者和验证者角色提高 AI 输出的可读性和准确率,强调技术进步是逐步迭代的。

3. 主要内容:

– OpenAI 发论文研究小学数学题

– 题目关于小帅、小帅爸爸和小美年龄关系

– 大模型在简单数学问题上常翻车

– 如比较 9.11 和 9.9 大小

– 提出 Prover-Verifier Games 框架(PVG)

– 受博弈论启发,解决模型输出质量不可控问题

– 不是新提出,3 年前有类似提法

– PVG 框架原理

– 提高答案可读性和可验证性

– 分证明者和验证者角色

– 证明者分有用和狡猾两种

– 经多轮迭代提升推理能力和可读性

– 提供论文链接和中英文对照 PDF 链接

– 介绍相关 AI 学习圈日更内容及周卡

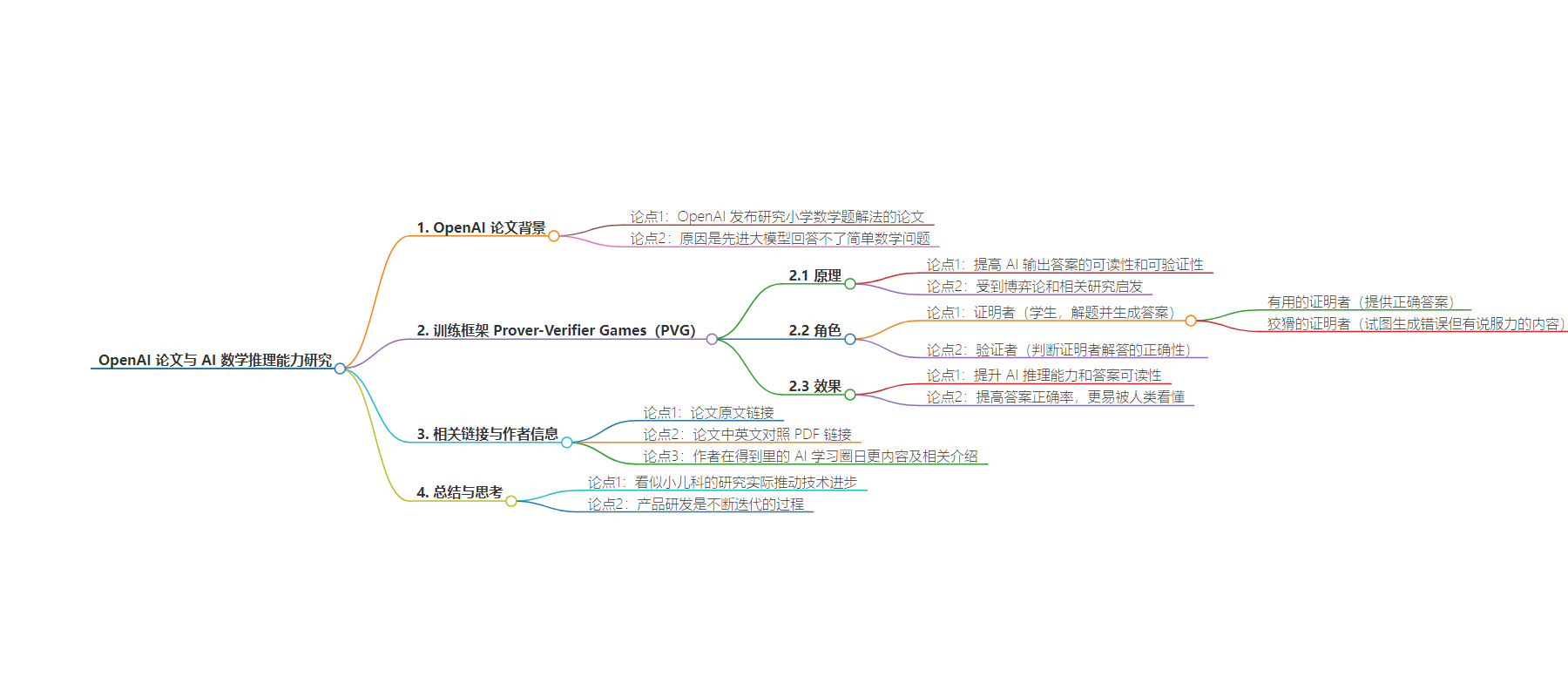

思维导图:

文章地址:https://mp.weixin.qq.com/s/h28JBTauPoyY8u62_JOeHw

文章来源:mp.weixin.qq.com

作者:快刀青衣

发布时间:2024/7/19 6:27

语言:中文

总字数:2235字

预计阅读时间:9分钟

评分:84分

标签:AI训练框架,数学问题解决,模型验证,OpenAI,大模型优化

以下为原文内容

本内容来源于用户推荐转载,旨在分享知识与观点,如有侵权请联系删除 联系邮箱 media@ilingban.com

前天,OpenAI 官方发布了一篇论文,这篇论文的核心是研究一道小学数学题的解法,题目是这样的,假设男主叫小帅,小帅的爸爸是小帅年龄的五倍,小帅又是小美年龄的 3 倍,已知小美已经 3 岁了,请问小帅的爸爸多少岁。

你一定非常惊讶,为什么这帮处在全球人类智商巅峰的科学家要来研究这种小学二年级的数学题。其实这也跟最近特别火的一个话题特别相关。就是国外一名叫Riley Goodside的工程师在问大模型的时候,发现一批非常先进的大模型却回答不了一个非常简单的数学问题,就是“9.11 和 9.9 这两个数到底哪个大”。从 ChatGPT 到克劳德到咱们的不少国内模型,在这个简单问题上都翻车了。当然,同学们现在就不要去试了,估计这个话题发酵之后,很多模型死记硬背也必须要答对了。

所以在跟 AI 协作的过程中,我们会发现 AI 能在 10 秒钟内画出一张赛博朋克的未来城市的复杂想象,也能瞬间给你生成一段程序代码这种复杂任务,还能写出一篇妙笔生花的文章,但是在一些常识问题上,特别是数学类问题上,却弱鸡得可怕。

之前有一个 TED 演讲,具体的内容我已经完全不记得了,但那个标题让我刻骨铭心,叫做《为什么 AI既聪明得令人难以置信,又愚蠢得令人震惊》。

我们上学时都有过回答数学题的经历,例如选择题或者填空题,你错了就全错了,因为没有人知道,为什么正确答案是 B你却选择了 C,你的答案就是一个黑盒。但如果是计算题,我们只要把步骤写出来,哪怕最终的结果错了,过程还是能拿到一些分数的,因为老师可以在这个过程中看到你的思考过程是不是正确。

而 OpenAI 新提出的这个全新的训练框架 Prover-Verifier Games,可以简称为 PVG,就是想来打开 AI 回答数学这类推理型问题的黑盒。例如用一个 GPT3.5 这样的小模型来验证和监督大模型的输出,从而提高答案的准确率,尽量的降低幻觉。

我已经把这篇论文用AI转成了中英文版本的 PDF,如果你有兴趣的话,可以在文章最后下载看看。

不过我用尽量简单,毫无技术名词的话给你讲一下这个框架背后的原理逻辑。

首先这个PVG 概念本身并不惊艳,同时也不是第一次提出来,应该在 3 年前就有类似的提法了。OpenAI 的这篇框架论文也是受到这个思路的启发,去解决模型的输出质量不可控的问题。论文一开始也说了自己的这项研究是受到了博弈论和相关研究的启发。

这个框架的核心就是提高 AI 输出答案的可读性和让 AI 去验证检查。啥叫可读性?就是 AI 怎么得出的这个答案,我们人类看得懂。例如论文里就举了开头那道数学题的例子,分别用一轮直接回答和五轮次检查回答。如果 AI 的回答没有可读性,那就是直接给你输出了一个计算结果,或者是简单的说一下步骤,放在这道题里就会直接说小美的年龄是 3 岁,那么小帅的年龄就是 9 岁,小帅爸爸的年龄就是 45 岁。解答完毕。

如果是按照 5 轮次的回答,那么AI 的回答就是“我们要先确认小美的年龄,现在我们知道是 3 岁。然后我们要确认小帅的年龄,现在我们知道小帅的年龄是小美年龄的 3 倍,那么在这里,小帅的年龄就是 9 岁。紧接着我们要算出小帅爸爸的年龄,我们知道小帅爸爸的年龄是小帅年龄的 5 倍。所以最后小帅爸爸的年龄是 45 岁。”

AI 这么回答的话,虽然显得啰嗦一点,当时我们人类在时间紧张的情况下,很多特别低级的错误也能一眼发现,哪怕 AI 胡说八道,我们也能知道它到底在哪步开始放飞自我的。

在这个框架里,我们只需要知道他们有两个角色,一个叫做证明者,一个叫做验证者。证明者你可以理解为学生,就是不断的解题,从前面的多轮训练迭代中,不停的生成答案。而验证者就是用自己的判断力来推断证明者的解答是不是正确。

为了进一步提高效率和难度,这个论文里又把证明者设计成两种,一种叫做有用的证明者,另一种叫做狡猾的证明者。有用的证明者大家都可以理解,就是正确答案,而狡猾的证明者其实就是试图生成错误的但是同样要有说服力的内容,以此来试图欺骗验证者,这样经过一轮又一轮的迭代,每一轮验证者都要经过一大批有真有假的答案训练,在这个过程中,AI 自己的推理能力和答案本身的可读性都会提升,对于我们来说,最大的体感就是未来 AI 给我们的答案正确率更高,并且更容易被我们看懂。

我不知道你听起来这个框架会想起什么?

我第一反应是想起了当年《射雕英雄传》里的周伯通,当时他自创了一门武功叫做左右互搏,因为对武功痴迷的他被关在了岛上,所以他就让自己的左手和自己的右手开始搏斗。后来他把这门功夫教给郭靖的时候,第一课就是”左手画方,右手画圆“。不过笨笨的郭靖很快就学会了,反而是聪明的黄蓉一直学不会。当时看到这里的时候,我和同桌就在上课时偷偷的开始一手画方,一手画圆。

所以回到开头,看似这篇论文是从一道小学数学题开始入手有点儿小儿科,但很多技术型的问题就是这么一点点的往前推进,一个人或者团队提出了一个想法,地球上不知道哪个地方的另外一个人受到了灵感启发,把这个想法再完善一点点,所以在产品研发这个领域,哪有什么”横空出世“,只有”小步快跑,不断迭代“。

—————

论文的原文链接在这里:

https://cdn.openai.com/prover-verifier-games-improve-legibility-of-llm-outputs/legibility.pdf

要是懒得看英文版的话,正好我用机器翻译完了,感兴趣的话可以自己下载了看。嗯,虽然我知道,这种大部分下载了,也不会看的,哈哈

论文中英文对照PDF链接:

https://pan.baidu.com/s/1MUVnAI_PbC0q2jhThNGGsA?pwd=9dn9

提取码: 9dn9

————-

这篇内容依然是我在得到里的 AI 学习圈的日更内容,这是第 185 篇。

除了每天的 AI 资讯外,里面更多的是各种实操教程,从 AI 设计海报到 AI 做每天的新闻资讯抓取助手,可以快速把 AI 用起来。

感兴趣的话可以领下面的一个周卡去看看。

如果身边有好用的 AI 创业产品,欢迎推荐给我,我愿意推荐给更多的用户。大厂产品就算了,是不会稀罕我的推荐的。