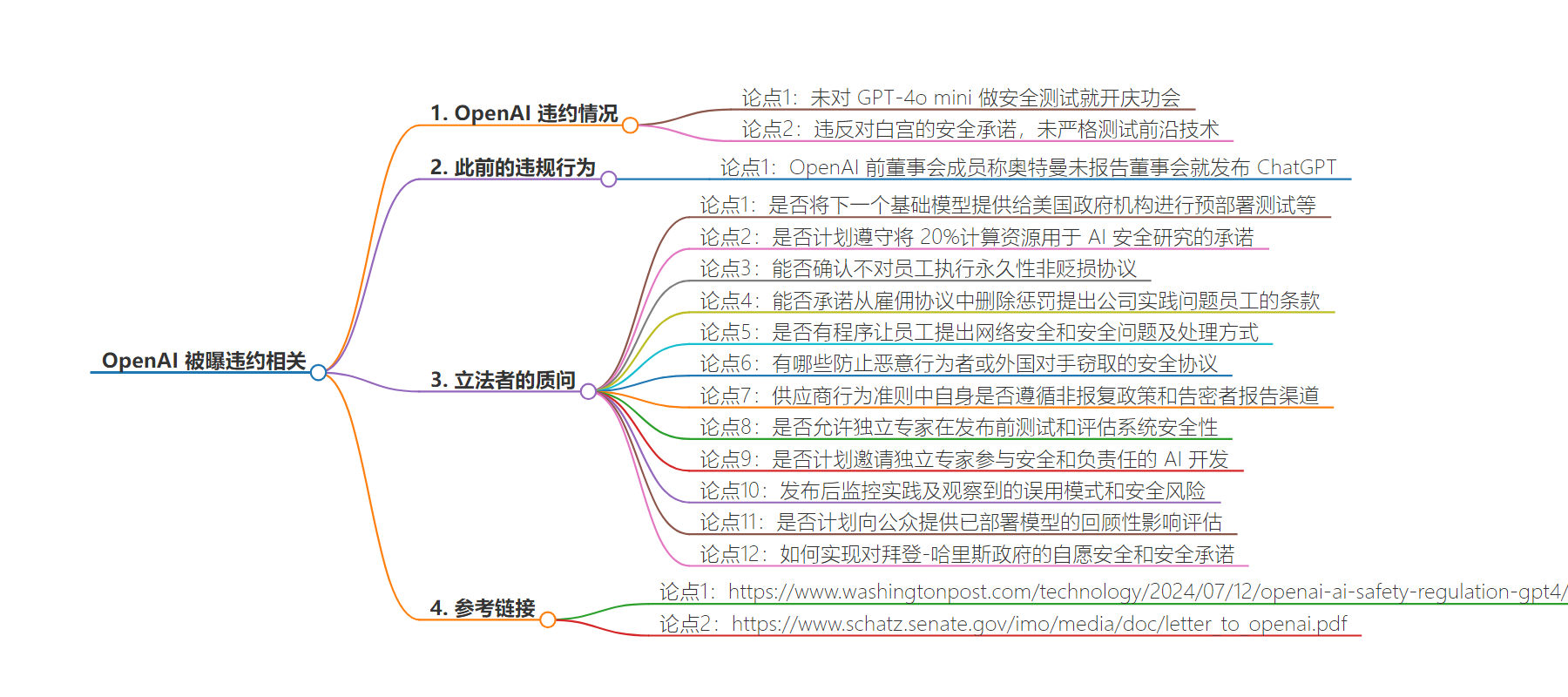

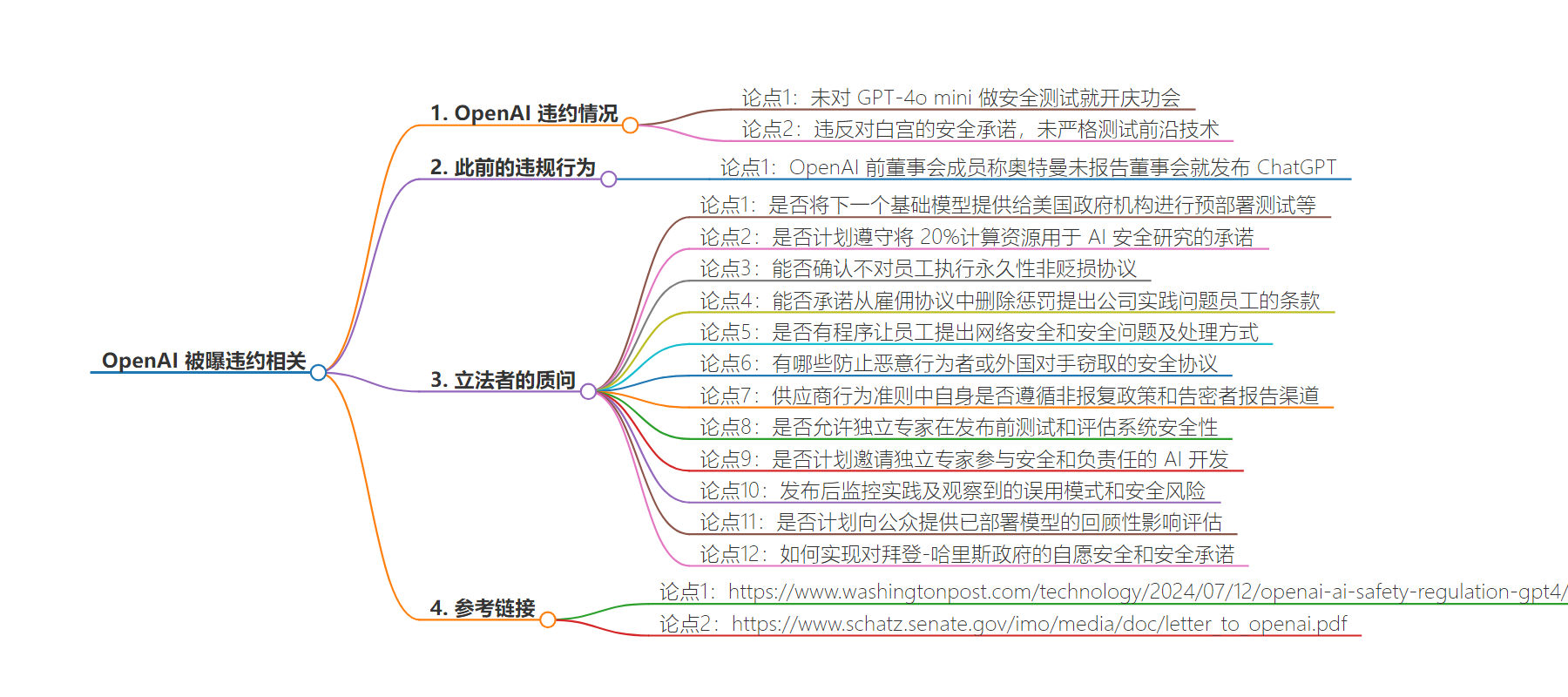

包阅导读总结

1. 关键词:OpenAI、GPT-4o mini、安全测试、违约、政府协议

2. 总结:OpenAI 被曝 GPT-4o mini 未做安全测试就开庆功会,严重违背对政府的安全承诺,被立法者犀利追问 12 条,包括计算资源用于安全研究、员工协议等问题。

3. 主要内容:

– OpenAI 曾向美国政府承诺对前沿技术进行安全测试

– 为应对领导层设定的 GPT-4o mni 5 月“deadline”,安全测试被“加快”

– 测试前就举办产品发布庆功宴,被指安全流程失败

– OpenAI 抢发产品有先例,前董事会成员称 ChatGPT 发布未报告董事会

– 参议院民主党人和独立议员致信奥特曼,犀利质问 12 个安全相关问题,包括计算资源用于安全研究、员工协议、安全协议、独立专家参与等

思维导图:

文章地址:https://mp.weixin.qq.com/s/YYFQvHDBzu4ucQY_Wuatxw

文章来源:mp.weixin.qq.com

作者:51CTO技术栈

发布时间:2024/8/1 5:08

语言:中文

总字数:1719字

预计阅读时间:7分钟

评分:88分

标签:OpenAI,GPT-4o mini,AI安全,安全测试,政府协议

以下为原文内容

本内容来源于用户推荐转载,旨在分享知识与观点,如有侵权请联系删除 联系邮箱 media@ilingban.com

太离谱!曝GPT-4o mini没做安全测试就开庆功会!OpenAI严重违背政府协议,被立法者犀利追问12条

编辑 | 伊风

OpenAI又被曝违约了!这次是违反了对白宫的安全承诺。

去年夏天,OpenAI向美国政府承诺,将严格对其前沿的突破性技术进行安全测试,以确保AI不会造成损害,比如教用户制造生化武器或帮助黑客开发新型网络攻击。

然而,为了应对OpenAI领导层设定的GPT-4o mni 5月份的“deadline”。OpenAI的安全团队中的一些成员感到压力,并“加快”了对新模型的安全测试过程。

根据三位熟悉情况但因害怕被报复的匿名人士透露,在模型GPT-4o mni的测试开始之前,OpenAI就已经在举办产品发布的庆功宴了!员工被邀请在OpenAI的旧金山办公室中举办产品的庆祝派对。

根据其中一个举报者说:“他们在不知道GPT-4o mni是否安全发布之前就计划了发布后的派对。”这位人士在匿名讨论敏感公司信息时表示:“我们基本上在这个(确保AI安全的)过程中失败了。”

OpenAI抢发产品也算是老传统了。此前,OpenAI前董事会成员曾在采访中透露,奥特曼没有报告董事会,就直接发布了ChatGPT。而当时的董事会成员甚至是浏览X才得到了该消息。

为了能进一步约束OpenAI的安全行为,保障前沿AI巨头可以将公共安全放在商业利益之上,参议院的民主党人和一名独立议员已公开致信奥特曼,犀利质问公司在对待批评者方面的安全标准和实践。

https://www.schatz.senate.gov/imo/media/doc/letter_to_openai.pdf

这封信件中最重要的部分之一(最先由《华盛顿邮报》获得)是第9项内容:“OpenAI是否承诺将其下一个基础模型提供给美国政府机构进行预部署测试、审查、分析和评估?”

信中列出了另外11个需要解决的要点,包括确保OpenAI承诺将其计算能力的20%用于安全研究,以及制定防止恶意行为者或外国对手窃取OpenAI产品的协议。

1.OpenAI是否计划遵守其先前公开承诺,将其计算资源的20%用于AI安全研究?

a.如果是,请描述OpenAI已经采取的、正在采取的或将采取的步骤,以将其计算资源的20%用于AI安全研究。

b. 如果不是,OpenAI用于AI安全研究的计算资源比例是多少?

2. 您能否确认贵公司不会对现任和前任员工执行永久性的非贬损协议?

3. 您能否进一步承诺从雇佣协议中删除任何可能用来惩罚公开提出公司实践问题的员工的条款,例如防止员工在私人“要约收购”事件中出售其股权的能力?

a. 如果不能,请解释原因,并说明任何内部保护措施,以确保这些条款不会被用来在经济上阻止告密者。

4. OpenAI是否有程序让员工提出有关网络安全和安全的问题?这些问题提出后如何处理?

a. OpenAI员工是否提出过对公司网络安全实践的担忧?

5. OpenAI现有或计划实施哪些安全和网络安全协议,以防止恶意行为者或外国对手窃取AI模型、研究或知识产权?

6. OpenAI供应商行为准则要求您的供应商实施严格的非报复政策,并为告密者提供报告问题的渠道,而无需担心报复。OpenAI本身是否遵循这些做法?

a. 如果是,请描述OpenAI的非报复政策和告密者报告渠道,以及这些渠道向谁报告。

7. OpenAI是否允许独立专家在发布前测试和评估OpenAI系统的安全性和可靠性?

8. 公司目前是否计划在其安全和安全测试、评估程序、流程和技术以及治理结构(如其安全和安全委员会)中,邀请独立专家参与安全和负责任的AI开发?

9. OpenAI是否承诺将其下一个基础模型提供给美国政府机构进行预部署测试、审查、分析和评估?

10.OpenAI的发布后监控实践是什么?在最近发布的大型语言模型部署后,您的团队观察到了哪些误用模式和安全风险?这些风险必须达到多大规模,您的监控实践才有很大可能性捕捉到它们?请分享您的团队在发布后测量中的经验教训,以及为改进您的政策、系统和模型更新而采取的步骤。

11.您计划向公众提供已部署模型的回顾性影响评估吗?

12.请提供有关OpenAI计划如何实现其对拜登-哈里斯政府的自愿安全和安全承诺的文件。

1.https://www.washingtonpost.com/technology/2024/07/12/openai-ai-safety-regulation-gpt4/

2.https://www.schatz.senate.gov/imo/media/doc/letter_to_openai.pdf

英伟达最强劲敌Groq一招绝杀GPU,反超GPT-4o mini2倍,AI大佬Karpathy:直接飞升AGI!

量化成为时代标准!AI大神贾扬清锐评Llama3.1:很难盈利、成本巨高、速度却马马虎虎

预览时标签不可点

![]()

微信扫一扫

关注该公众号

![]()

微信扫一扫

使用小程序

:,。视频小程序赞,轻点两下取消赞在看,轻点两下取消在看分享收藏