包阅导读总结

1. 关键词:AI 生成、图像视频、真假难辨、潘多拉魔盒、技术影响

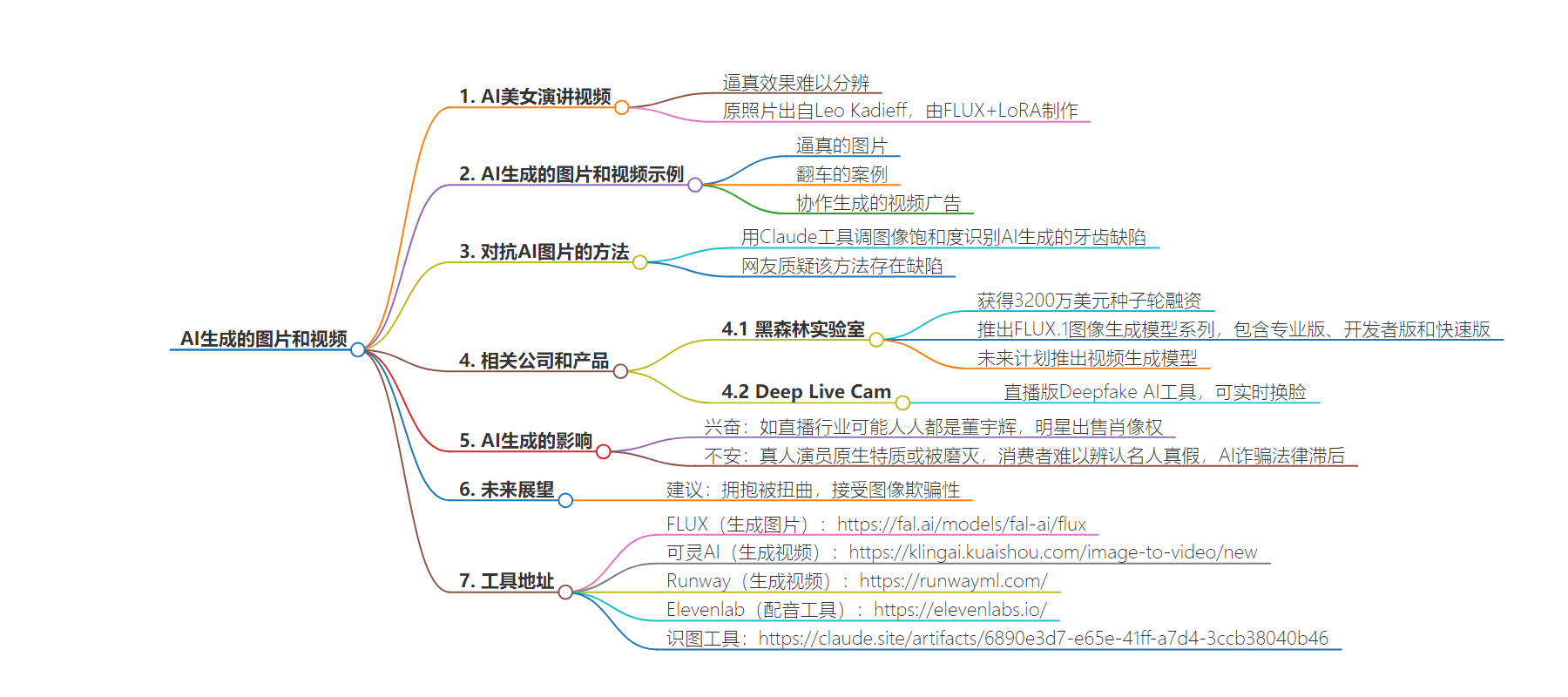

2. 总结:AI 生成的逼真图像和视频引发广泛关注,其质量高但也有翻车案例,虽有识别方法但存在缺陷。相关技术发展迅速,带来机遇也引发担忧,如对演员特质、肖像权、法律等方面的影响。

3. 主要内容:

– AI 生成的演讲者视频:逼真效果让网友和 AI 识别软件难以分辨,原照片出自特定团队和成员。

– 生成过程与效果:主要分文生图、图生视频两步,生成效果有优有劣,有工具能对抗但存在缺陷。

– 相关技术与公司:如 Stable Diffusion 原班人马成立新公司推出 FLUX 模型,还有 Deep Live Cam 等工具。

– 影响与担忧:可能磨灭演员特质,侵犯肖像权,法律滞后,消费者和名人面临困扰。

– 未来展望:人类处于兴奋与不安的十字路口,需思考如何应对。

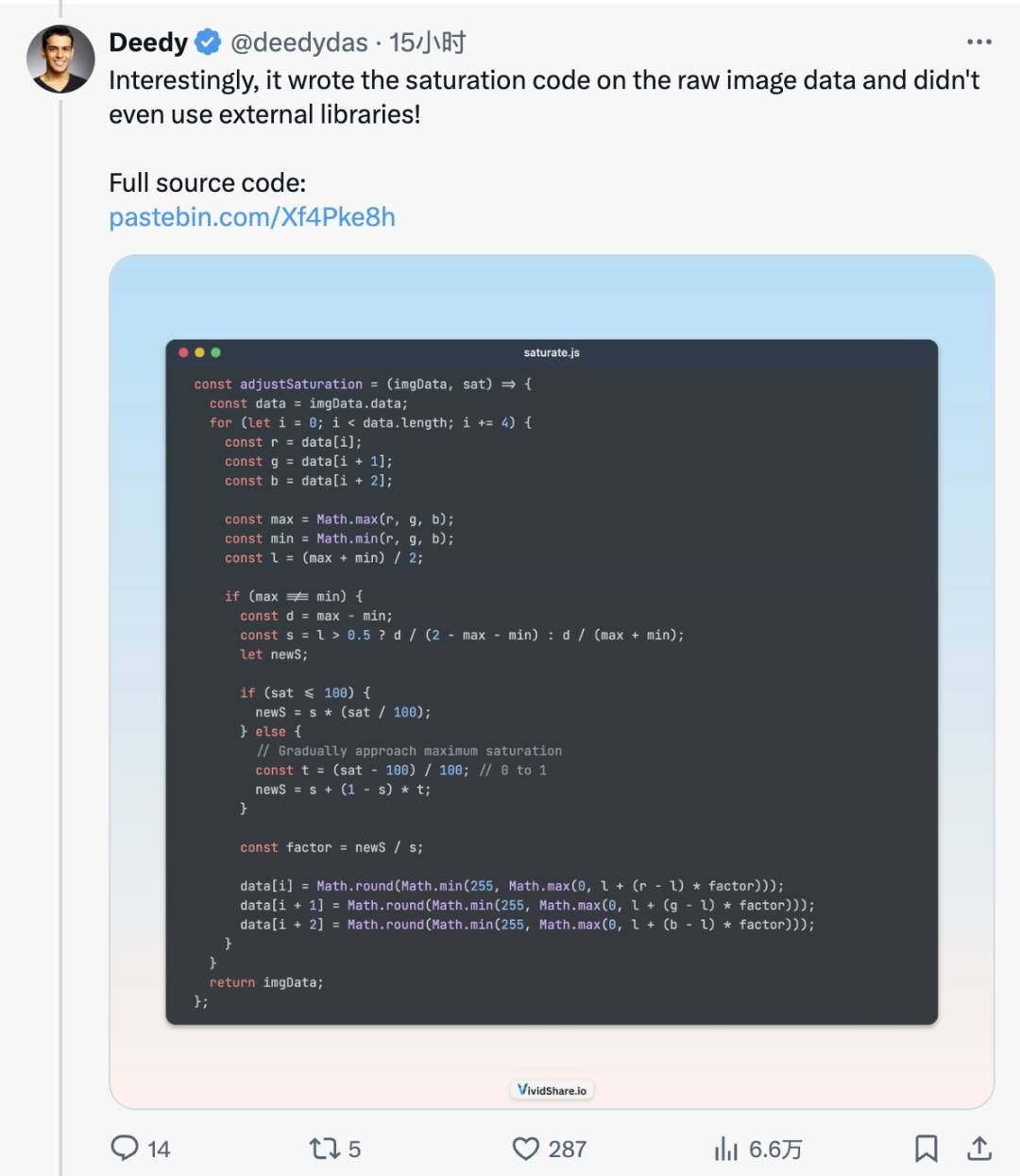

思维导图:

文章地址:https://mp.weixin.qq.com/s/5nXC2gKMEWD1EnzMsOK6kA

文章来源:mp.weixin.qq.com

作者:发现明日产品的

发布时间:2024/8/12 11:12

语言:中文

总字数:2752字

预计阅读时间:12分钟

评分:89分

标签:AI 生成内容,图像识别,视频生成,Stable Diffusion,FLUX

以下为原文内容

本内容来源于用户推荐转载,旨在分享知识与观点,如有侵权请联系删除 联系邮箱 media@ilingban.com

骗过数百万网友的 AI 美女演讲,被这个赛博照妖镜扒光,但潘多拉魔盒已经关不上了

已经分不清网络上的图像和视频是真人还是由 AI 生成的了。

这是我的一位同事在看完最近遭到疯传的 TED 演讲者视频发出的感慨,也是这几天网上数百万人的感受。

如果不是抱着「知道答案找问题」的心态去审视这些视频,不仅我们难以分辨,就连 AI 识别软件也得懵圈。而这般逼真的效果,很大程度上取决于图片过硬的质量。

此前《劈波斩浪》的导演陈坤也曾提到,和传统电视剧拍摄手法有所不同,AI 视频生成主要分两步走:文生图、图生视频。

经过一番深挖,网友发现这个视频的原照片正是出自 Stable Diffusion 团队的前成员 Leo Kadieff 之手。

他在 LinkedIn 揭秘道,这些所谓的 TEDx 演讲者照片其实是由 FLUX+LoRA 制作而成的,过程中甚至不需要经过任何的微调。

他还表示,仅需一个 22MB 的小文件,用户就不必在每个提示词里堆砌一大堆与真实相关的词汇。简单一句「一张 RAW 超现实照片,超高清,8k」就足以解决生成的照片没有人味的问题。

附上 FLUX 体验地址:https://fal.ai/models/fal-ai/FLUX

短短几天,仿佛潘多拉的魔盒已经打开,越来越多真假难辨的图片/视频正在迅速占领社交媒体。

为了避免混淆,网友特意给图片打上了文字标注,看着眼前逼真的图片和「I am not real」的提醒,如此割裂的场景,瞬间让人毛骨悚然。

网友分享了几张「2015 年左右的无聊的 Snapchat 照片」,这看起来像是某个外国友人逝去的青春,但很遗憾,这全都是由 FLUX 生成的。

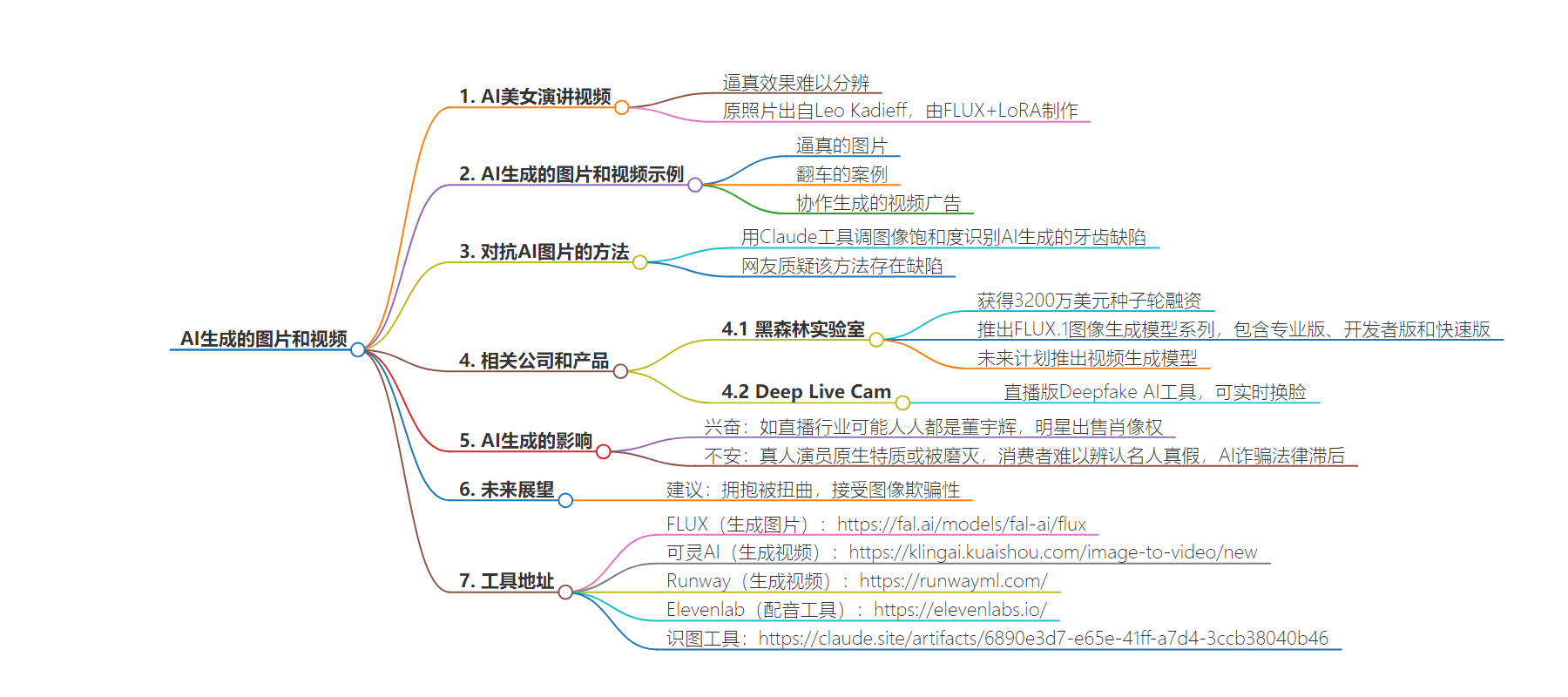

不过,也有翻车的案例,比如像下面这张在 TEDx 大会上,身着恐龙服装的模特手持麦克风,脖子上挂着 Google 标志挂绳的图片,看着 AI 味就很重。

静态图片也已经进化到 next level 了,搭配可灵 AI、Runway 等视频生成工具,图片就能「活」起来。看看网友这支用 FLUX 和其它 AI 工具协作完成的视频广告,会勾起你购买的欲望吗?

从能引起恐怖谷的「威尔・史密斯吃意大利面」再到如今真假难辨的视频生成,短短不过两年时间,却截然上了一个大台阶。

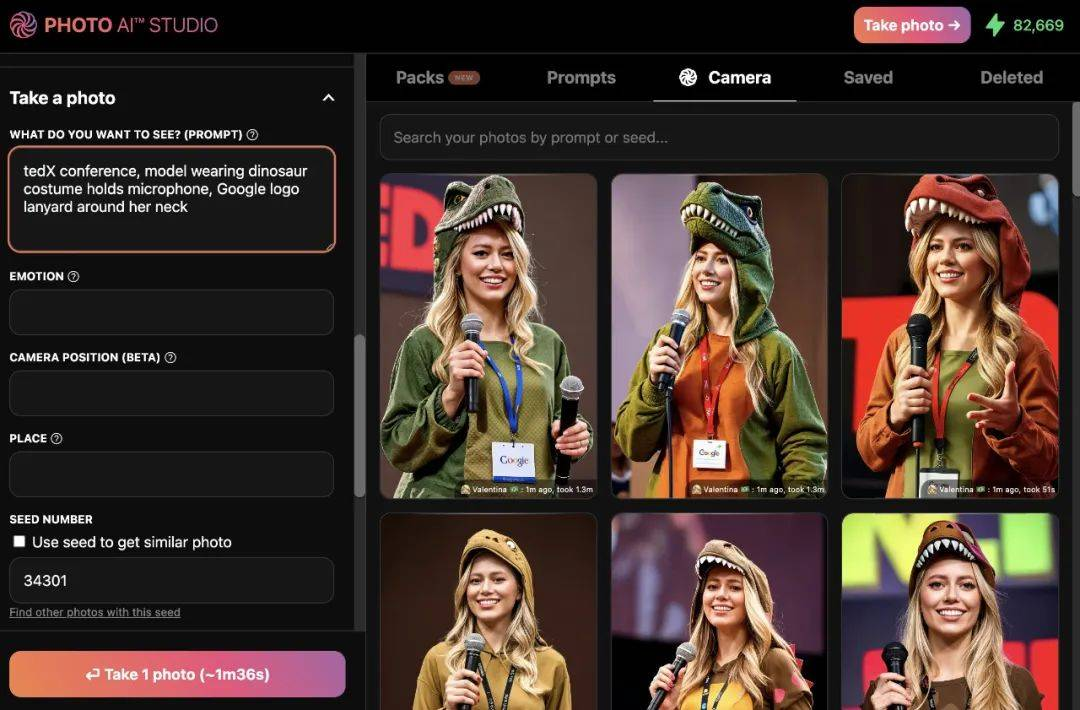

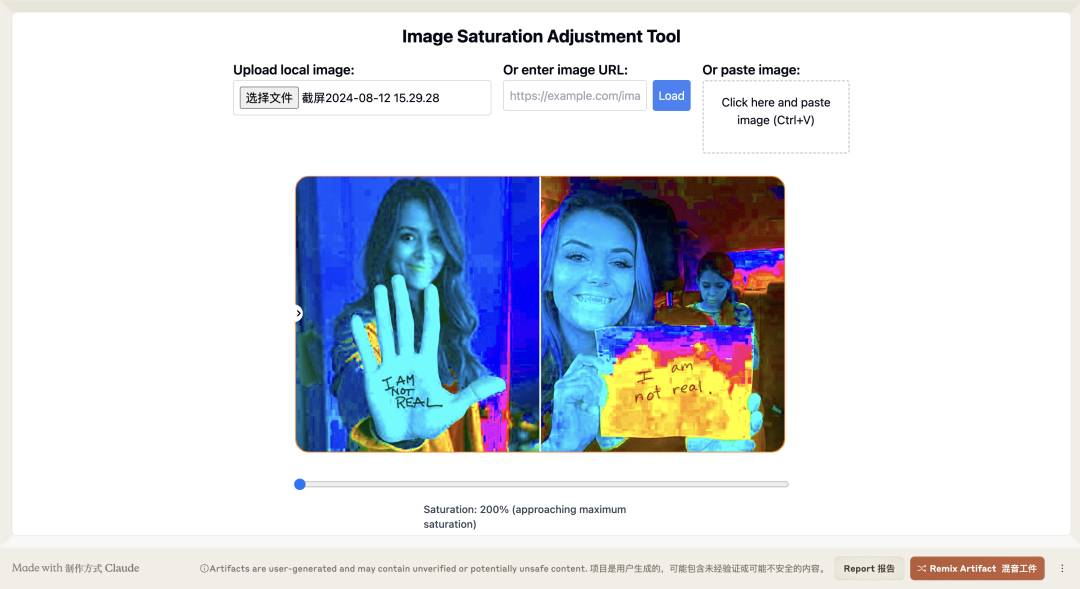

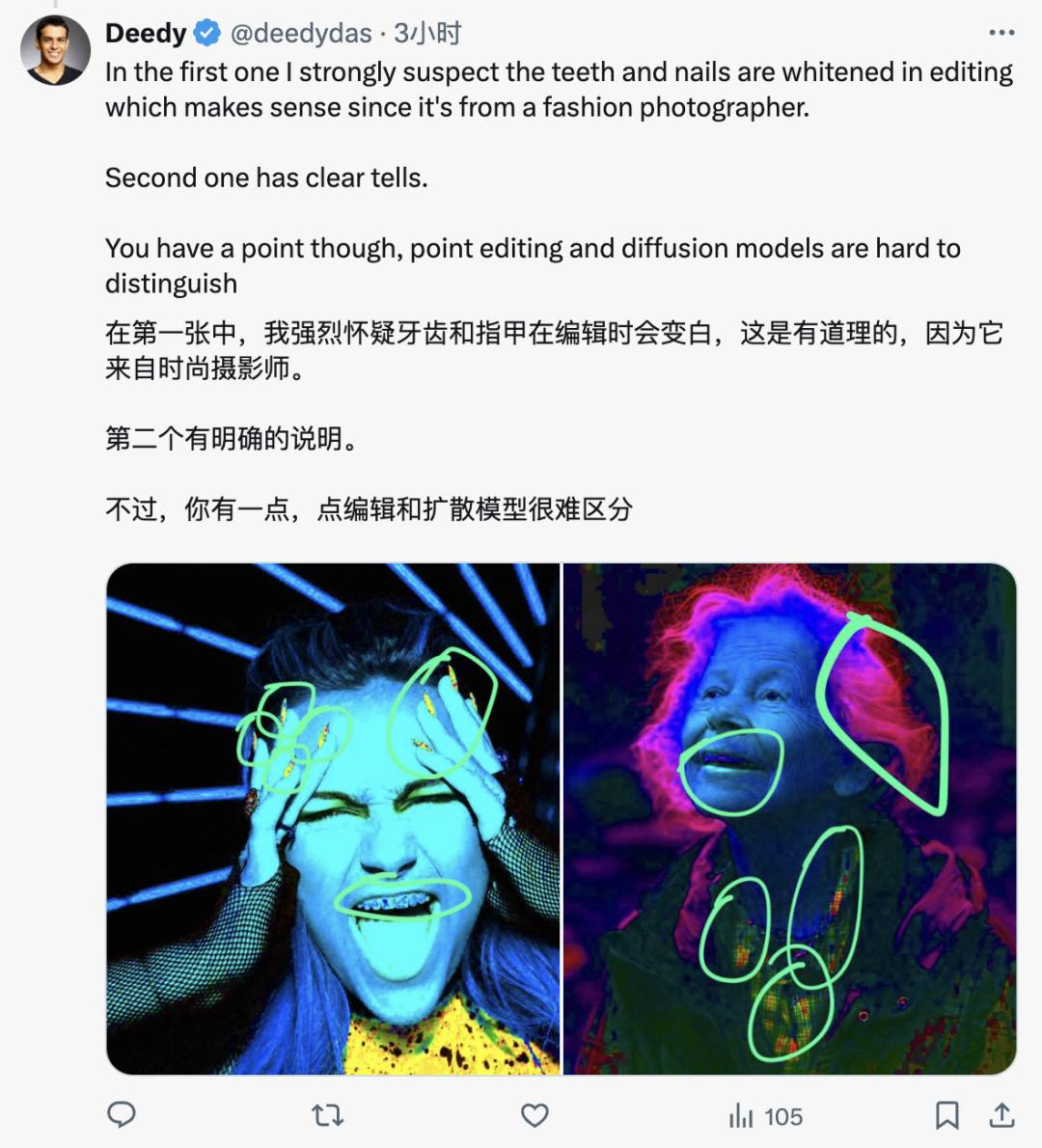

此外,以子之矛攻子之盾,倘若将图像饱和度调至最高,AI 生成的牙齿就会显得异常诡异,甚至图像色彩整体也极不协调。

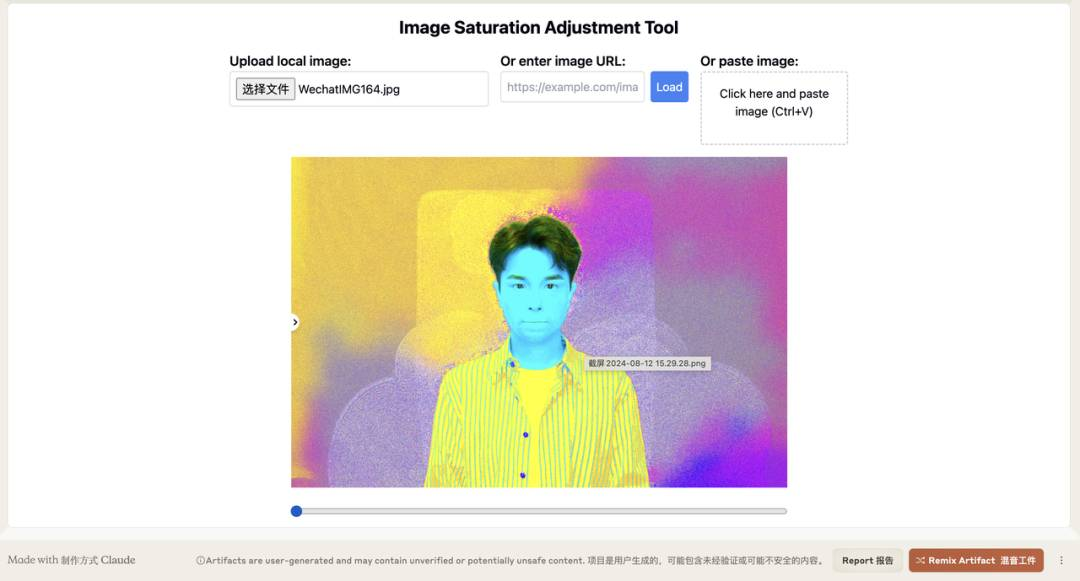

一时间,人类仿佛找到了对抗 AI 图片的新大陆。而这个工具正是出自 Claude 之手,堪称用 AI 魔法打败魔法,有杀毒软件和网络病毒互撕的那味了。

那这种方法靠谱吗,别急着高兴,老规矩,我们得先实测一下。比如我随手上传了我身旁同事的真实照片,嗯——怎么看着有些不太对劲?

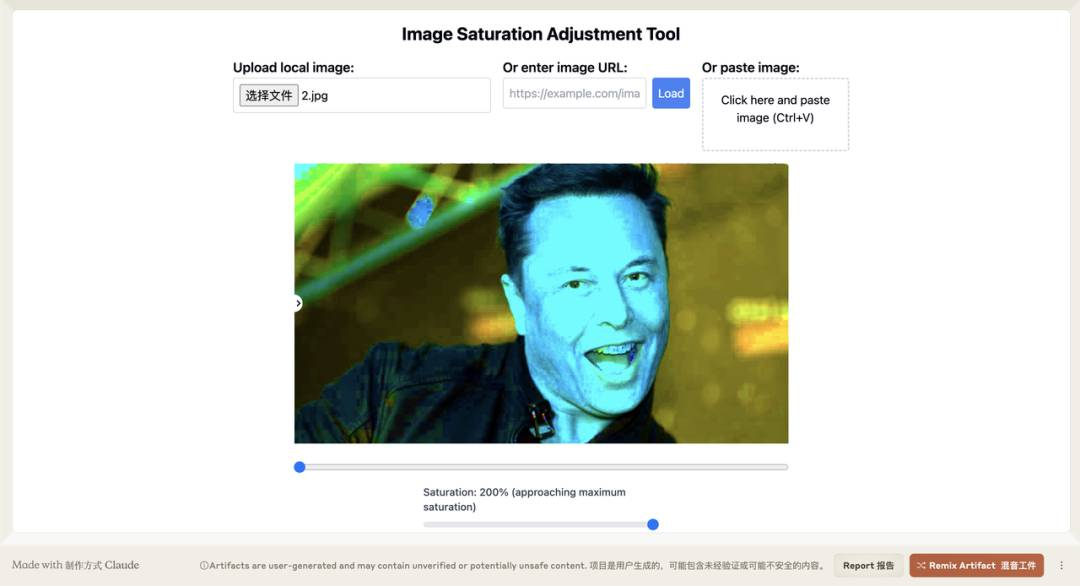

再将马斯克这张最经典的露齿图上传,把饱和度拉到最大,但仔细看下来,似乎也不太符合上面提到的「牙齿」定律。

不光我这么想,回过味来的网友的质疑声也如潮水般涌向工具原作者的评论区。

有些网友觉得,高质量的 AI 图片在颜色和亮度的平衡上,可能比人类用 Photoshop 编辑得还要好,而这种识别方式明显有失偏颇。

人们通常通过识别图片压缩和颜色变化来判断图片是否由 AI 生成,但这可能是错误的,因为这些特征也可能是由其他因素(如反射表面或光线条件)造成的。

甚至同时放出了人类与 AI 生成图片直观的识别效果,并直接对着作者一顿贴脸输出。

面对网友的一连串质疑,招架不住的工具与作者也不再那么「嘴硬」,承认了这种识别方法存在的一些缺陷。

正如上面所述,FLUX 正是出自 Stable Diffusion 原版人马之手。

本月初,Stable Diffusion 的原班人马也成立了新公司——Black Forest Lab(黑森林实验室)。其中该公司由 Stable Diffusion 的核心开发者 Robin Rombach 领衔。

公司刚成立,Black Forest Lab 就获得了 3200 万美元的种子轮融资,领投方是著名风投机构 Andreessen Horowitz(a16z),多位业内知名人士也参与了投资。

Black Forest Lab 推出的首个产品便是名为 FLUX.1 的图像生成模型系列,其中包含了专业版、开发者版和快速版三种版本,这些模型在视觉质量、提示词遵循、图像细节和输出多样性等方面都达到了新的高度。

FLUX.1 [pro]:顶级性能版本,提供最先进的提示跟随和图像质量,通过 API 和精选合作伙伴获得。

FLUX.1 [dev]:开源权重、指导精简的模型,适用于非商业用途,提供与 pro 版本类似的性能但更高效。

FLUX.1 [schnell]:最快的版本,专为本地开发和个人使用而设计,基于 Apache 2.0许可证。

据官网透露,文生图的推出仅仅是个起点,未来该公司还将计划推出视频生成模型。当时,前 OpenAI 大神 Andrej Karpathy 也在线送上祝福,称开源的 FLUX.1 图像模型非常强大。

结果不出所料,不到两周时间, FLUX 便掀起了当下的病毒式传播。

与此同时,玩梗的网友表示,已经没有人稀罕那个每天提供两次免费生成图片机会的 DALL·E 3 了,因为现在的 FLUX.1 才是艺术家们永远的神。

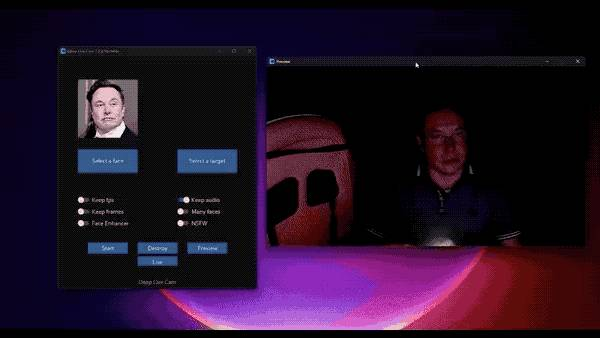

而在上周末同期爆火的还有直播版 Deepfake AI 工具——Deep Live Cam。

用户只需一张照片即可在视频或图像中实时换脸,且整个换脸过程仅需几分钟就能完成,无需依赖于任何专用的硬件加速设备。

当不成世界首富,但至少可以顶着马斯克的脸过一把世界首富的瘾,以至于有网友调侃,马斯克一觉醒来,发现自己在全世界直播。

甚至有 Reddit 网友发现,在 Google 浏览器上搜索「贝多芬」图片,排名第一的竟然是由 AI 生成的肖像。

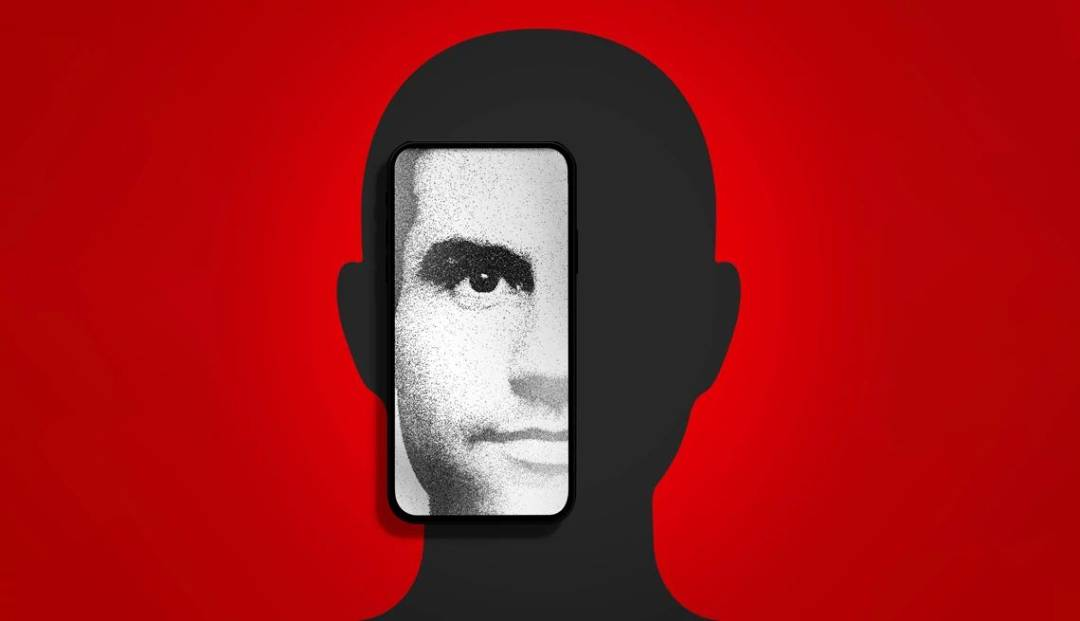

从前段时间曝出的 AI 文字污染蔓延至图片/视频领域,越来越多的信息空间正在被 AI 占领。我们正站在一个令人既兴奋又不安的十字路口。

兴奋的是,假如一张照片就能做到视频换脸或实时换脸,放到一些诸如直播以及等行业来说,这是否意味着人人都是董宇辉的时代正在来临。

甚至不少大牌明星也已经开始向 AI 出售自己的肖像权。

此前,传奇演员布鲁斯·威利斯(Bruce Willis)授权 AI 公司 Deepcake 创建他的「数字替身」,并在未来的项目中使用他的脸和肖像,而威利斯则不必参与任何拍摄或制作。

就这样,在 AI 技术的重塑下,这位 68 岁高龄且患有「失语症」的传奇影星得以以另一种「曲线」形式重返「大荧幕」。

但不安的是,真人演员的原生特质或许也会被逐渐磨灭,成为导演和制片人手中肆意摆弄的乐高,如同流水线一般,一点一点地「拼出」整部影视作品。

在如此逼真的数字形象中,「眼见为实」的常理将遭到严峻的考验。

作为消费者,又该如何去辨认视频中的名人们究竟是自己所认知的人类,还是只是作品制作者手中的「提线木偶」?作为名人,在面对肖像权受到不法侵害时,又该如何证明「我」不是我的人生哲学?

即便是放到最为热议的 AI 诈骗议题上,当 AI 以最亲近的面孔化身收割普罗大众的镰刀,而现有的法律在这紧锣密鼓的 AI 节奏中明显慢了一拍之时,人类又似乎只能束手无策。

或许在这类技术大规模应用之前,我们只能山不转水转,正如《连线》作者 Jason Parham 曾提出的建议:

让我们拥抱被扭曲,接受生活在图像充满了欺骗性的无常中。我们要保持勤勉,因为未来是一个持续理解和「去理解」,崩塌和重建的游乐场。

FLUX(生成图片):

https://fal.ai/models/fal-ai/flux

可灵 AI(生成视频):

https://klingai.kuaishou.com/image-to-video/new

Runway(生成视频):

https://runwayml.com/

Elevenlab(配音工具):

https://elevenlabs.io/

识图工具:

https://claude.site/artifacts/6890e3d7-e65e-41ff-a7d4-3ccb38040b46

预览时标签不可点

![]()

微信扫一扫

关注该公众号

![]()

微信扫一扫

使用小程序

:,。视频小程序赞,轻点两下取消赞在看,轻点两下取消在看分享收藏