包阅导读总结

1.

关键词:ServiceNow、AI、竞争优势、企业搜索、工作流

2.

总结:本文主要探讨了 ServiceNow 的竞争优势,包括产品全面可定制、积累的信用、优质服务等,介绍了其在 AI 方面的战略及应用场景,如工作流自动化、数字化、知识库整合等,还阐述了企业搜索的特点、难点及进展,以及与其他产品的关系和应对数据治理等问题。

3.

主要内容:

– ServiceNow 的竞争优势

– 产品全面可定制、自动化,满足大企业业务需求

– 起步早积累良好信用

– 提供专业支持服务,注重安全性等

– ServiceNow 的 AI 战略

– 与工作流系统结合更智能

– 实现更多数字化和功能自动化

– 整合知识库与外部应用

– 加强隐私保护和安全性

– 开发针对不同场景的定制模型

– 企业客户使用 AI 的场景

– 总结功能

– 对话 Q&A

– 内容生成

– 工作流生成

– Now Assist 产品

– 增长快且提价客户仍接受,能整合操作流程,智能程度较高

– 底层用自己训练的模型

– 企业搜索

– 与传统文本搜索不同,难点在于语言模型和性能

– 创业公司与 ServiceNow 优劣势

– 最新进展为 GA 状态,与 Elastic Search 关系等

– 规避幻觉问题和平衡数据治理问题

– AI Agent 对 ServiceNow 的影响,认为是受益的,已在 Now Assist 中有所体现

思维导图:

文章地址:https://mp.weixin.qq.com/s/BeGQ4ZyDmBI1Lv_pYJeSYg

文章来源:mp.weixin.qq.com

作者:拾象

发布时间:2024/8/2 12:31

语言:中文

总字数:10729字

预计阅读时间:43分钟

评分:82分

标签:AI重塑软件公司,GenAI,ServiceNow,AI应用,企业转型

以下为原文内容

本内容来源于用户推荐转载,旨在分享知识与观点,如有侵权请联系删除 联系邮箱 media@ilingban.com

ServiceNow 的 AI 策略

Q:Kewei 在公司工作的这几年整体体验如何?你觉得 ServiceNow 能做到这么好,最重要的竞争优势是什么?

Kewei:我不是从事业务运营方面的,所以我只能从个人体验上去理解。我觉得 ServiceNow 的竞争优势主要有三个。第一是 ServiceNow 的产品,它提供了一个非常全面的解决方案,这样就能满足大企业很多的业务需求,同时 ServiceNow 的产品能够高度地定制化和自动化,这点对大企业来说非常重要,而且覆盖面也很广。这样企业降本增效的效果就会非常明显。

第二,美国 SaaS 企业中非常重要的就是信用,因为 ServiceNow 起步非常早,到现在已经 20 多年了,它在这段时间里积累了很好的信用,这对面向大企业的 SaaS 公司来说非常重要,因为大企业客户更希望能跟自己信得过的企业合作,也愿意花更多的资本来跟这些公司合作。

第三可能就是服务,ServiceNow 提供专业的支持和服务团队,并且非常注重安全性、合规性和可靠性,虽然可能在用户体验方面这些因素并不是非常重要,但是 ServiceNow 在这方面做得也比较好。

Q:对大企业客户来说,信任和安全确实非常重要。您刚才也提到第一重要的还是产品,从产品角度,不管是开发、设计,还是理念上,ServiceNow 有什么比较大的竞争优势?

Kewei:ServiceNow 的产品在设计上非常简单,因为所有的东西都是以表格为基础,这点放在 use case 上会非常简单,用户有任何需求,都可以先创建一个表格,这样就可以和企业内部运营更好地关联起来,后续的一切都在这个表格的基础上操作。如果需要定制或者是别的新业务,都可以通过这个方面来实现。不仅非常直观,还能减少沟通上的一些障碍。

Q:定制化的软件通常的交付的过程会比较重,或者每一个订单可能都是比较 customized 的,但 ServiceNow 在定制化和产品的可组合方面平衡得比较好,不知道你们有没有什么特别的经验和观点?

Kewei:这是我们引以为傲的工作流系统,从设计上来讲,以表格为基础,并以工作流作为底层的引擎来驱动自动化和定制的需求,这样在实现和用户使用体验上就会好很多,也会快很多。

Q:ServiceNow 在 GenAI 的投入一直很积极,现在整个 ServiceNow 对 AI 的战略大概是什么样的?主要会在哪些板块去做 AI?

Kewei:公司高层对 AI 相当兴奋,在投资者开发大会上也提过,公司对 AI 的投入比重非常大,基本上是 all in。相对于别的公司,AI 其实可以和 ServiceNow 现有的产品有机地整合在一起,这是很明显的特性,ServiceNow 在 ChatGPT 火之前已经积累了很多 AI 的基础,可以说已经修炼了很久,所以现在相当于时机成熟了,相对于别的公司而言,ServiceNow 能够更快地把 AI adopt 到产品里面。

在战略上面,公司会从这五个方面来实现:

第一,自动化方面,把工作流系统与 LLM 结合在一起,变得更智能,智能可以体现在工作流的设计或者生成上,以及与外部的整合上。

第二,更多的数字化,把一些之前需要手动的功能实现自动化,并整合到 ServiceNow 的 Now Assist 里,这可以更好地提升效率。

第三,在知识库方面,通过企业搜索把所有的知识整合在一起,在这个基础上利用 Assist 与外部的应用整合。传统的知识搜索要先搜索找到想要的结果,再进行下一步,然后根据内容中提供的指令去做。现在可以把这些全部整合起来,搜索以后直接就可以执行要做的事情,这可以极大地提高效率。

第四,在隐私保护和安全性上,现在 AI 在这方面还是比较欠缺的,如果 ServiceNow 可以做好这方面,就可以更好地吸引大企业客户。

第五,在实现策略上,这点比较好的是 ServiceNow 没有用传统的大模型,而是针对不同场景开发了很多小而精的高度定制模型。比如生成工作流是一个模型,生成文本是一个模型,生成代码又是另外一个模型,这些都是 ServiceNow 自己开发、并运行在自己的硬件上的,这对那些注重安全性和隐秘性的公司就很有吸引力。

Q:客户对刚刚提到的这五个方面产品的实际反馈是怎么样的?在这个过程中客户最在意什么?

Kewei:客户的整体反馈还是很好的,因为毕竟相对于之前的 AI / Machine Learning 功能,LLM 提供的体验和精确度完全不一样,是全新水平的体验。但是我觉得企业客户采用新技术会比较保守,他们会试用、观察、不停地考虑,所以他们采用的速度会比较慢,不过目前整体来看趋势还是很好的。

Q:我们最近观察到一个趋势是:很多企业实际上可能并不一定需要用 SOTA 模型来解决实际业务中的需求,而是选择用特定的小模型来做任务,ServiceNow 为企业客户提供的服务涉及到小模型的训练,以及结合客户实际的 use case 做模型fine-tuning 这类内容吗?

Kewei:涉及到模型 ServiceNow 有很多种方案,但总的来讲有三个:

•第一,可能有一部分客户的需求还是用 OpenAI 的模型,在这种情况下,我们是通过 API 的方式把数据文本发给 GPT;

•第二,用 ServiceNow 自己的模型,目前通用的是 Now LLM,但是还会有一些别的应用的模型;

•第三,我们接下来会推出 BYOM (Bring your own model),客户可以选择用自己的模型,通过 API 的方式整合到 ServiceNow 的系统里。比如如果有企业考虑到用 ServiceNow 或者其他模型公司的模型都有可能把数据分享出去,所以就选择自己训模型,但在实际使用中还是要把自己训的模型和具体产品、设备、工作流耦合,BYOM 的方式就是作这样的整合,非常灵活。

Q:在第二类情况中,ServiceNow 的模型是从头训的,还是说用开源的模型 fine-tuning 实现的?

Kewei:一般都是会用开源的模型,但是会比较有针对性、比较小巧,不会采用很大的模型。一方面是成本的考虑,另一方面是性能、效率的考虑,毕竟现在算力还是比较有限的。虽然 ServiceNow 从与 Nvidia 的合作中获得了一些显卡,但在使用上还说很节约的,所以训练小模型的话,一个显卡可以同时支持好几个模型、好几个客户,在成本上会比较优化一些,但也会基于开源的模型进行 fine-tuning,把自己的 Gen-AI 数据放进去。

Q:在你们的观察中,企业客户目前用 AI、并且用的比较好的 use case 主要是在哪些场景?

Kewei:第一个目前比较成熟的就是 summarization,利用 LLM 来总结。

ServiceNow 最大的一个产品是 ITSM,ITSM 相当于 ticket 系统,客户有问题时就会创建一个 ticket、或者一个 case,如果这个 case 比较复杂,一个 case 界面可能会洋洋洒洒好几页、有好几百个记录更新,涉及到好几个月。如果后面问题解决了,要总结这个界面,一个人读那么多内容再总结会非常费时间,summarization 就可以提供一个总结的功能,把这个 case 的一些问题、解决方案全部总结出来,这样后面如果要去参考会比较快。所以 summarization 是针对 ServiceNow 非常好的一个 use case,当然, summarization 也是目前 Gen-AI 比较通用的一个使用场景,可以用在很多地方。

另外一个就是和 chatbot 对话 Q&A,这其实也是 Now Assist 的基础功能,相比于之前类似的功能,Now Assist 的 Q&A 可以提供更好的使用体验,不但可以给出结果,还可以直接帮用户咨询很多 action,然后直接执行。

其次是内容生成,比如用户在创建 ticket 的时候,可以把一些繁琐的步骤全部自动化掉。之前有一个 demo 就是在生成内容的时候,输入一些基本的东西,Now Assist 就会把基本的内容全部填完,同时写好一份 summary,非常方便。

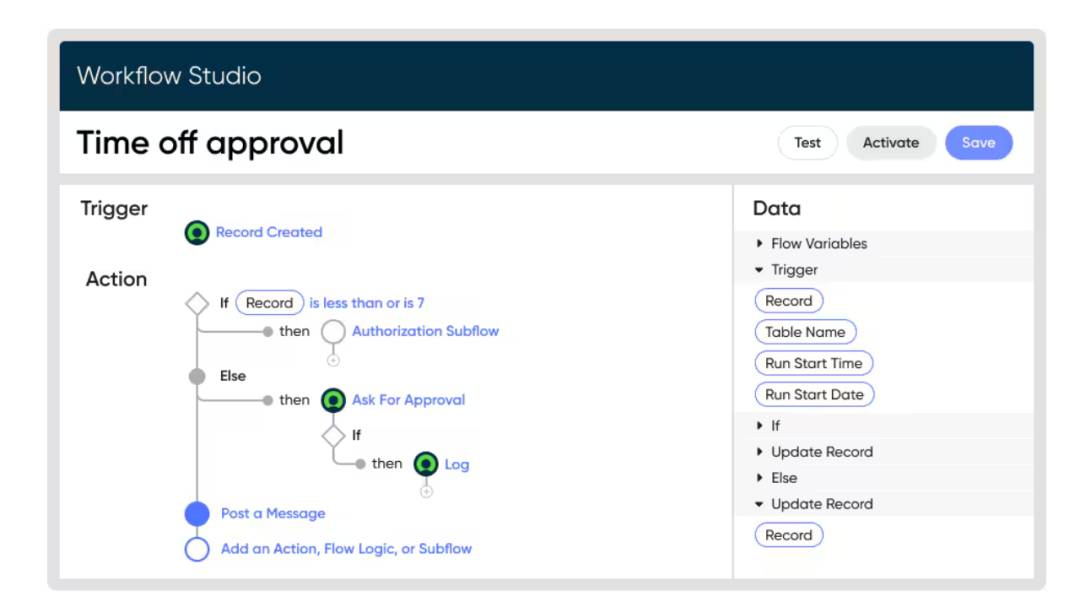

最后,我觉得比较好的一点就是工作流的生成,用户可以写一段文字,然后由 AI 自动生成工作流。后续的产品会更加先进,比如用户在白板上画了一个之前在会议上讨论的工作流,可以拍照上传,由 AI 直接生成一个工作流,这会是更进一步的优化。

这些是我觉得目前使用的一些契合度比较高的场景,接下来也会有一些新的场景,但更多是 business intelligence 方向上的,用户可以直接向 Now Assists 提问来获得更多数据的 insight,这可能会间接替代一些商业决策中 data analysis 的工作。

除了文本任务之外,workflow 相关的功能也已经比较成熟了,因为企业内部有很多数据,所以也可以利用之前 workflow 的数据来训练一个基于 workflow 的模型,这个是 Now Assist 的一个优势,但 BI 方面现在还在开发中。

Q:Now Assist 是 ServiceNow 的 AI 产品,也是历史上增长最快的一个产品,而且很有意思的一点是:就算 Now Assist 提价 30%,客户似乎也愿意接受。这个产品对客户最主要的价值是什么?为什么它能有这么快的一个增长?

Kewei:这个产品比较大,涉及到好几个组。但因为我不是从最上面往下看的角色,所以我也只能分享我这边接触到的一些东西。

我个人的理解是:第一,Now Assist 可以非常好地整合到之前的一些操作流程中,所以从客户角度来说,他们不需要另外花很多资源去培训、学习这个功能,与 Copilot 有点像,但是可能会更好,很多时候其实或多或少已经整合到系统中去了。比如用户去看一个 KB (Knowledge Base) 文档,可能就会提示用户点一下,就可以自动总结出要点,后面还会有一个按钮,相当于触发了 Q & A 的模式,这样的话学习的成本就会很低,很多企业都会愿意去试用或者使用,因为效果非常好,而且他们已经不需要再花钱培训了,所以可能自然而然地就会想要使用这个产品。

另外,虽然 Now LLM 没有达到 100% 的智能,但是它现在至少可以达到 70%-80% 的智能程度,这已经非常不错了。

Q:Now Assist 底层用的模型是什么?

Kewei:是我们自己训练的模型,Now LLM 的模型会负责一些文本上的操作,底层是 Q & A 的模式,是通过企业内部 AI 搜索来实现,另外就是一个非常复杂的自然语言处理的 embedding 模型,这个模型比较关键,因为它会直接影响到问答的效果,以及最终结果。

Q:如果客户愿意接受提价,那你们认为对客户会怎么衡量产品给他带来的 ROI?

Kewei:我觉得效率的提升这点是最直接的。客户衡量的角度包括,一个 case 的处理时间,或者一个用户在搜索时得到结果不符情况下花的时间和成本,还有问答本身。从时间上来考虑,这个产品节省的时间可能相对于担负的成本会更多。

企业搜索

Q:你在 ServiceNow 内比较专注 AI 搜索相关的产品,企业内搜索也是今年大家特别关注的话题,ServiceNow 是怎么理解企业搜索的?

Kewei:ToB 的企业搜索和传统的文本搜索不同。

首先,ToB 的内容更加多样,除纯文本外,还包括更多结构化的文档,比如 office 的 PDF、Outlook 邮件、Confluence 和 SharePoint,这不同于谷歌索引的那种传统的网页内容,所以它实现的方式也不太一样。传统的企业搜索效果不是特别好,就是因为这些文档越来越大,所以索引的效果或者收录的效果都会比较差或者比较慢,而且占用的资源也比较多。

但我认为 GenAI 图片在语义搜索、自然语言处理方面,为企业搜索提供了一个新的平台,如果可以利用 GenAI 模型来理解自然语言,在了解语义和生成结果方面的效果会非常好。

如果再把这个技术用得更抽象一点,相当于把企业搜索引擎进化成一个底层的 Vector 的搜索引擎,还可以利用这个底层的引擎开发更多基于 GenAI 的应用,这也是现在我们公司内部正在实现的一个事情,慢慢地把这个东西抽象出来,变成一个更通用的、可以整合 LLM 的工具。

Q:从产品和技术的角度,你们感觉做好企业搜索的难点主要在哪里?

Kewei:难点有两个,一是语言模型,也就是对自然语言的理解,以及对结构型文档的匹配,如果一个语言模型不太精确,结果也不会很精确,这一点是我们目前重点在解决的。

另一个是性能,因为模型本身做 embedding 生成向量比较慢,后期再去调用 LLM、API 或者 OpenAI API 来生成一个满意的 summarization 也比较费时间,整体的搜索时间也会比之前的久,用户体验上可能也不会像传统谷歌的文本搜索一样快。

Q:我们也看到企业搜索是不少创业团队选择的方向,包括 Glean、Hebbia 等等,其中有些也积累了不少企业客户,从你们的角度来看,创业公司相比于 ServiceNow 这样比较有积累的公司,分别都有什么优劣势?

Kewei:我个人理解,创业公司因为比较灵活,可以非常快地迭代或者开发产品功能,用户体验也会比较好,因为它的产品足够新,相当于是重新设计的,做一些改动或者变化会非常简捷。但劣势首先是信用方面,也就是品牌认知度,作为初创企业要吸引大企业会比较困难,第二则是在资源方面,因为资源有限,在市场推广、营销、客户支持方面,尤其是在售后支持,如果要吸引大企业,这方面也需要比较大的投资。

老牌企业相对来说资源会比较丰富,信用、品牌认知度也比较有积累,而且客户积累也是相当关键的优势。如果客户之前已经部署过安装了 ServiceNow 的系统,那他们肯定会优先考虑用 ServiceNow 的一些功能,这样就可以直接整合到他们的日常操作中来。

因为 ServiceNow 的产品本身比较复杂,如果要采用,员工需要进行一定的培训,只有培训成熟,才能保证后续的使用效率。其实不管是 Salesforce,还是 ServiceNow,我个人觉得都不是很好用,员工能够直接上手使用的可能性比较小,因为一些传统软件基本的功能比较庞大,所以前期一旦要采用,肯定要花一些时间去培训公司的员工,但是这个培训不仅仅局限于 AI 功能,之前几十年积累起来的一些软件功能也需要培训。

所以如果客户前面已经投入了很多培训或者学习,那他们一般不会轻易去换一个新的产品或者公司。

但大企业相对于初创团队最大的问题就是行动比较慢,在开发新产品或者调整策略方面也会比较慢,这也是为什么目前 Glean 能够快速占领一部分企业市场的原因,而 ServiceNow 在开发、推出新产品、新功能方面相对来说就会比较慢。但其实从今年开始,由于 AI 的紧迫性,我们也在快速地推出产品,所以现在变成了一年 4 次,一般每三个月就会有一个新的 release。

Q:ServiceNow 的 AI 搜索最新的进展如何?

Kewei:这个 AI 搜索已经是 GA(Generally Available) 的状态了,现在用户在 ServiceNow App 里面点击搜索图标去做搜索的话,后台其实都是通过AI 进行的,如果在 Now Assist 问问题,后台其实也是经过 AI 搜索完成的,但这两个场景后面其实是不同的 configuration。一个可能是传统的企业搜索外加整合 LLM 来提供一个结果的 summarization,另一个是企业搜索跟 skill 的定义整合起来后,直接调用相关的工作流。AI 搜索其实类似于一个端口,相当于一个入口,后面再根据定义定制、调用相关的结果或者相关的 APP。

Q:ServiceNow 搜索和像 Elastic Search 这类产品之间的关系是什么?可以理解为 Elastic 是后端引擎,ServiceNow 是前端和整个应用端的 wrapper 吗?

Kewei:可以,因为 ServiceNow 搜索的底层还是用的是 Lucene,Elasticsearch 的底层其实也差不多,在底层库的应用上来构建搜索的应用,并进一步构建了搜索引擎。ServiceNow 之所以没有用 Elasticsearch,是因为 Elasticsearch 控制性不够,不能完全满足 ServiceNow 高度定制的需求,所以它相当于收购了之前的一个 AI 搜索公司,它的优势是它完全是自主研发的,它的 Lucene 引擎也是自己定制的,所以可以实现各种需求。

现在的一些语义搜索也是直接在底层 Lucene 上实现的,而不是在 Elasticsearch 上实现的,这样可以非常灵活地选用模型来计算 Vector,或者在哪一步索引的时候实现安全性,加权限也非常的灵活。Elasticsearch 目前也有企业搜索,但主要适用于定制性不是很多的中小企业。如果要完全掌控自己的搜索引擎还得自己研发。

计算 Vector 是另外的模型,或者是用 GTR,或者是用 E5,看你用哪个语言模型。Vector 搜索是传统的 KNN(K-Nearest Neighbor)算法,这个比较通用、也比较成熟。如果对等路径一样,可以通过把两个 Vector 做一些计算来获得一些 match。

Q:因为企业用户对于搜索要求的准确度要求要比 To C 端更高,ServiceNow 是如何在 AI 搜索的结果上规避幻觉问题、提高搜索结果的?

Kewei:目前来讲,搜索结果只能用内部的一个 Q 组来测试,通过测试和调整来验证,基本上可以达到某个指标,不过不可能做到 100% 精确,但可能会达到 80%、 90% 的效果。客户其实会有一定的预期,但是他们不会有 100% 的预期。我个人感觉除非持续地出现一些问题,他们才会反馈,如果只是偶尔出现一些幻觉,他们应该不会太在意。但客观来说,我接触到的也不是特别多,我感觉前期出现过一些反馈,我们及时调整了之后,现在已经好多了。

Q:企业搜索的实现中是如何平衡类似于员工数据这类 data governance 问题的?

Kewei:我们提供了一个非常强大的配置功能可以对每一个文档或者每一个文件数据源设置权限,哪些 user group 的人可以看这些文档。其实很多这些元数据是用户传进去的,传进去之后,比如你是属于 group A,如果某些文档明确限制 group A 的人不能看,那你其实是搜不到,如果那些内容不会返回,也就不会体现在最后的结果里。

Q:Agent 也是生产力场景下很受关注的一个领域,这个概念背后的期待是:LLM 除了理解文本、回答问题,还能相对自主地、并有一定推理能力地去帮助用户处理一些复杂的任务。ServiceNow 本身就是围绕企业 workflow 中的各类任务展开的,从你的角度来看,随着 AI Agent 的发展,ServiceNow 会受益还是受损?

Kewei:我个人觉得是受益的,因为我觉得它们是可以整合在一起的,它们生成的一些 action 可以用工作流去实现。因为从内部的实现角度来讲,相当于是一个一个的 skill,训练了一个模型,并给了它很多技能,这个技能其实就是用工作流去实现的,这样用 Agent 的时候,AI Agent 就会通过后台返回一些它会的技能,这个技能可以通过事先制定好的工作流去执行,这样就会非常的自动化和智能。

而且其实这些目前 Now Assist 已经实现了。根据用户问的问题,Now Assist 会提供一些选项,让用户去执行一些要求。

举个例子,我们可以在 Now Assist 的 Q&A 中先询问公司的 PTO (带薪休假)政策是什么,它首先会把结果总结给你,而不是像之前那样提供几条知识库链接,除此之外,Now Assist 的 Q&A 还会提供再一个选项,例如“申请 PTO” 或者其他相关 动作?如果点击了“申请 PTO” 的按钮,那么后台就会自动执行这个工作流,直接帮员工完成请假,或者更进一步让员工先选定时间,再去自动申请 PTO,这些其实已经全部整合在 Now Assist 里了。

Q:在企业搜索中,针对企业有大量的结构化数据,当然也有一些非结构化的数据,也许这些数据在不同的 API 里,调用的时候要花一点时间,但如果用 LLM 为基础来做搜索,是不是会比在完全广阔空间中搜索更容易、更可靠?

Kewei:目前来讲,LLM 在企业搜索场景中,其实和我们直接向 ChatGPT 提问这种搜索是不一样的,这样的效率会比较低,成本也会比较高。

目前做企业搜索的公司,比如说 Glean,他们做大模型可能只是做最后的总结体验,前面的搜索还是传统的基于搜索引擎或者基于 Lucene,或者基于别的 Vector 的一些搜索引擎来做的,他们可能会用语义搜索来获得 5 – 10 个比较好的候选文档,然后把这些文档送给大模型来提炼出一个比较好的答案,这是目前的实现方式。

因为目前会受到算力或者成本的限制,所以这个路径对企业采用大模型是一个比较优化的方案,但是最后提炼结果的效果还是比较好的,相对于传统的搜索引擎来讲,已经是一个比较大的提升了。

Q:理论上由于企业搜索面临的数据量更加有限,如果对企业积累的这些数据做处理,相对来说会比较容易,那么它是不是应该在算力、成本、包括结果返回时间和幻觉上,有更好的表现?

Kewei:因为企业内部的文档数据量其实很大,虽然不能跟 Google 这种通用搜索引擎的的数据量来比,但如果就内部时间而言,需要的硬件资源也很多。如果要在这个基础上来训练大模型,成本确实还是很高的。

以目前的条件来讲,我们一些客户内部的 KB 文档可能就有好几个 T 的存储量,如果现在就 token 数量去给 OpenAI 或者自己训练一个模型,成本还是很高的。另外,有些企业可能还会需要一些别的定制,比如有些公司是法律文档,里面的修改要求很高,这些如果用大模型可能就会不太好。