包阅导读总结

1. 快手、快意大模型、关键技术、应用落地、创新挑战

2. 快手的「快意」大模型在 2024 年全球人工智能技术大会上被汇报。介绍了多项关键技术创新及应用落地中的经验挑战,包括超参搜索、损失函数优化等技术,还提及在 AI 小快应用中的挑战与解决方案,其已在多个站内场景落地取得业务收益。

3.

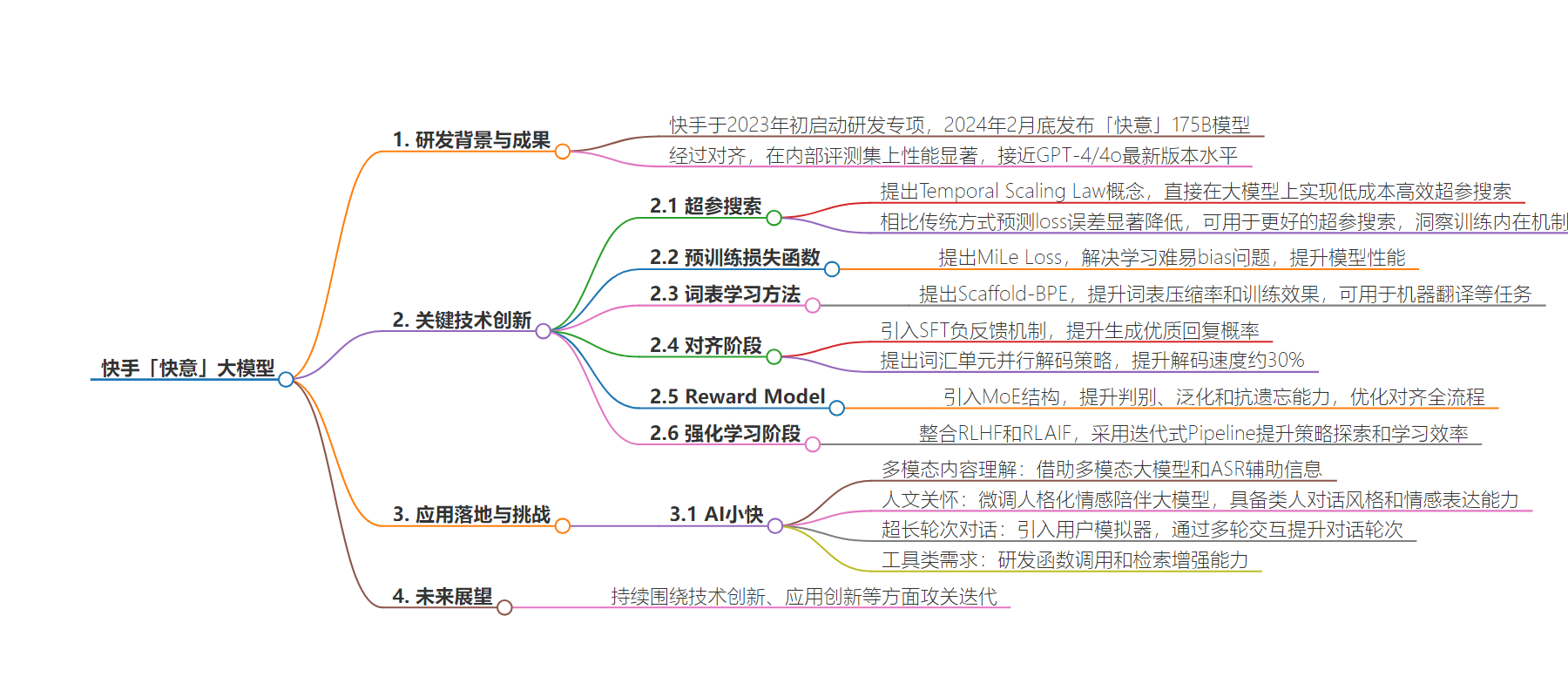

– 快手「快意」大模型

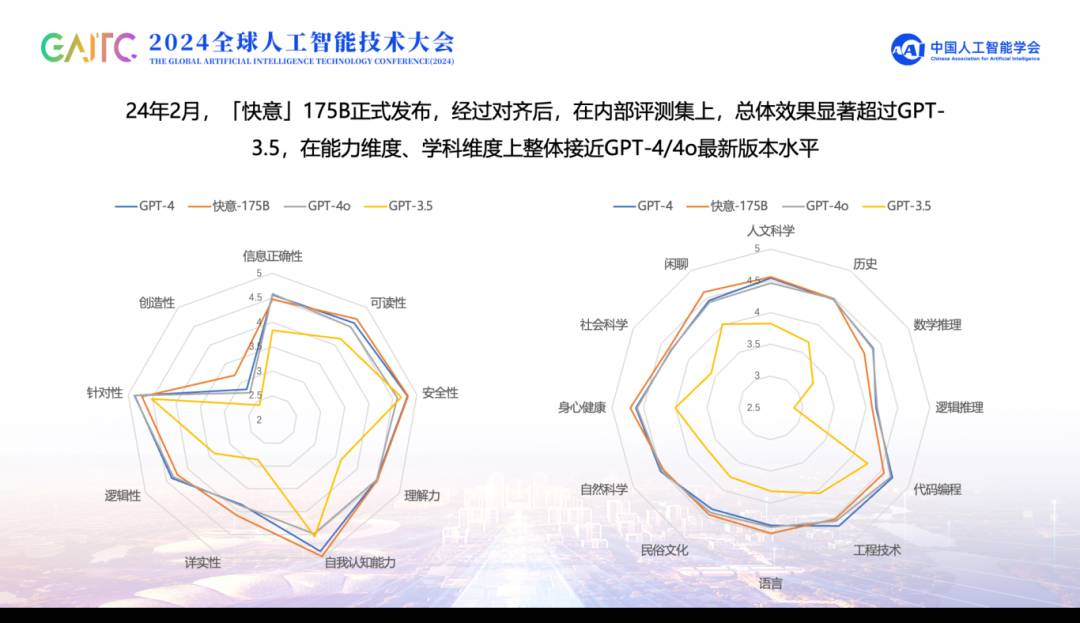

– 研发背景:快手于 2023 年初启动研发专项,2024 年 2 月底发布「快意」175B 模型,性能接近 GPT-4/4o 最新版本水平。

– 关键技术

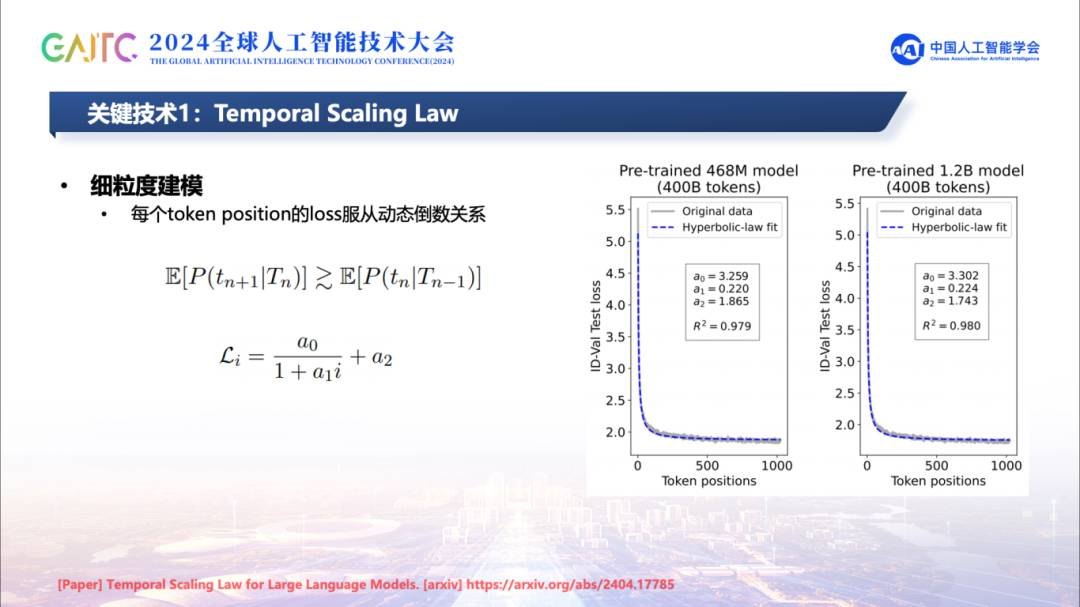

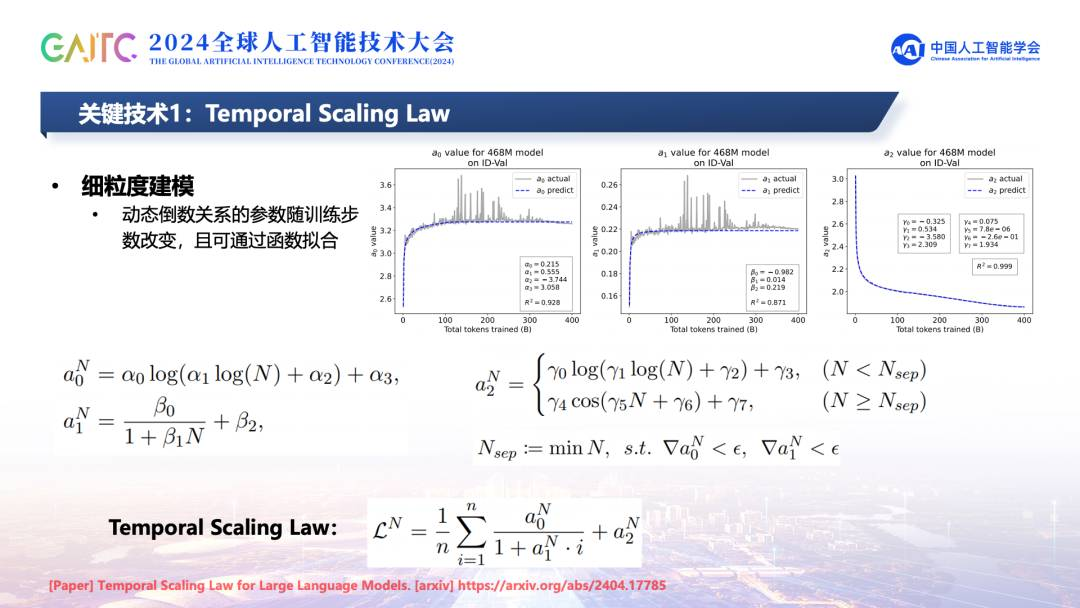

– Temporal Scaling Law:直接在大模型上实现低成本高效超参搜索。

– MiLe Loss:预训练损失函数优化方案。

– Scaffold-BPE:词表学习方法改进。

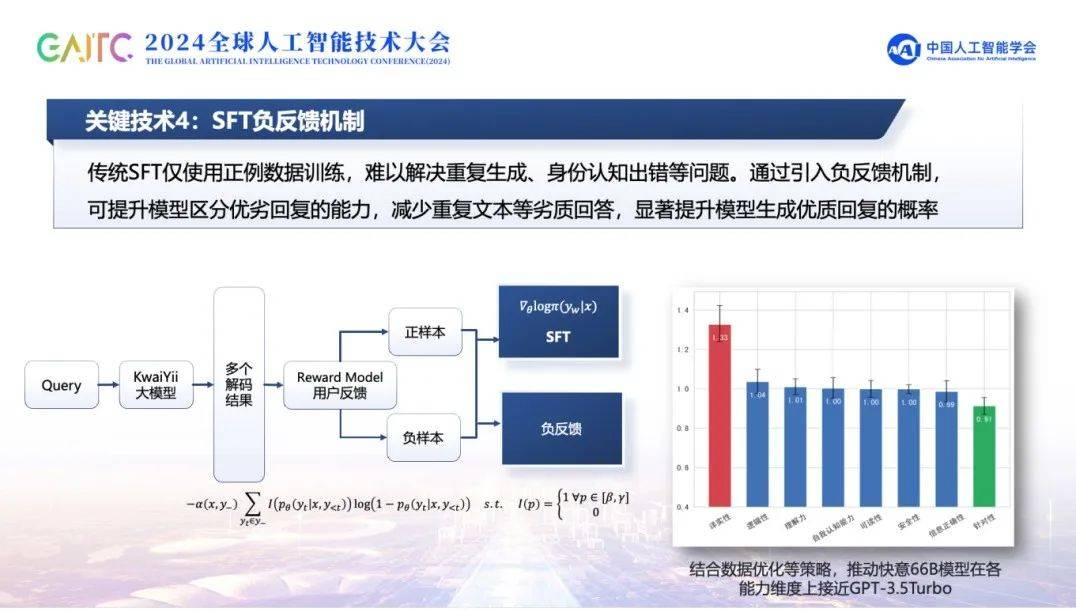

– 引入 SFT 负反馈机制提升生成优质回复概率。

– Reward Model 引入 MoE:优化对齐阶段全流程。

– 迭代式 RLHF+RLAIF:提升策略探索和学习效率。

– 应用落地与挑战

– AI 小快:具备多模态内容理解和人格化互动能力,在发展中面临多方面挑战,通过技术攻关找到解决方案。

– 业务收益:在多个站内场景落地,取得系列业务收益。

– 未来展望:团队将持续围绕技术与应用创新攻关迭代。

思维导图:

文章地址:https://mp.weixin.qq.com/s/DlT4vaJ9f8VNRWa_SP_Dvg

文章来源:mp.weixin.qq.com

作者:快手大模型

发布时间:2024/7/17 10:16

语言:中文

总字数:5285字

预计阅读时间:22分钟

评分:90分

标签:大模型,人工智能,快手,技术创新,应用实践

以下为原文内容

本内容来源于用户推荐转载,旨在分享知识与观点,如有侵权请联系删除 联系邮箱 media@ilingban.com

2024年6月,GAITC 2024全球人工智能技术大会在杭州举办,在视觉大模型关键技术与应用主题论坛上,快手NLP专家林梓佳向参会者汇报了快手「快意」大模型研发过程中的多个关键技术创新,以及应用落地过程中的经验与挑战。

全文共4072字,预计阅读时间10分钟。

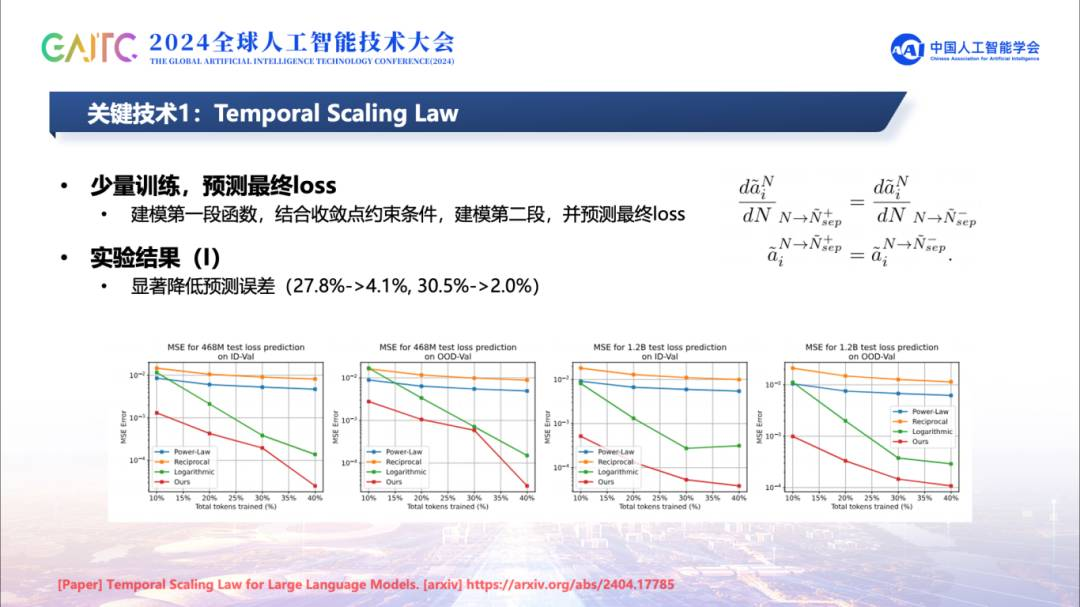

一、Temporal Scaling Law:直接在大模型上实现低成本的高效超参搜索

而在预测阶段,由于只训练少量的数据,往往只能看到分段函数的第一段,为了得到最终的结果,可以通过分界点的定义预测其位置,并在分界点处,通过增加数值平滑的约束条件,推导出第二段函数的参数,进而可以得到完整的分段函数和最终的loss预测结果。经过实验验证,Temporal Scaling Law相比于以幂律关系等方式建模整体loss的方式,在预测loss方面误差显著降低。

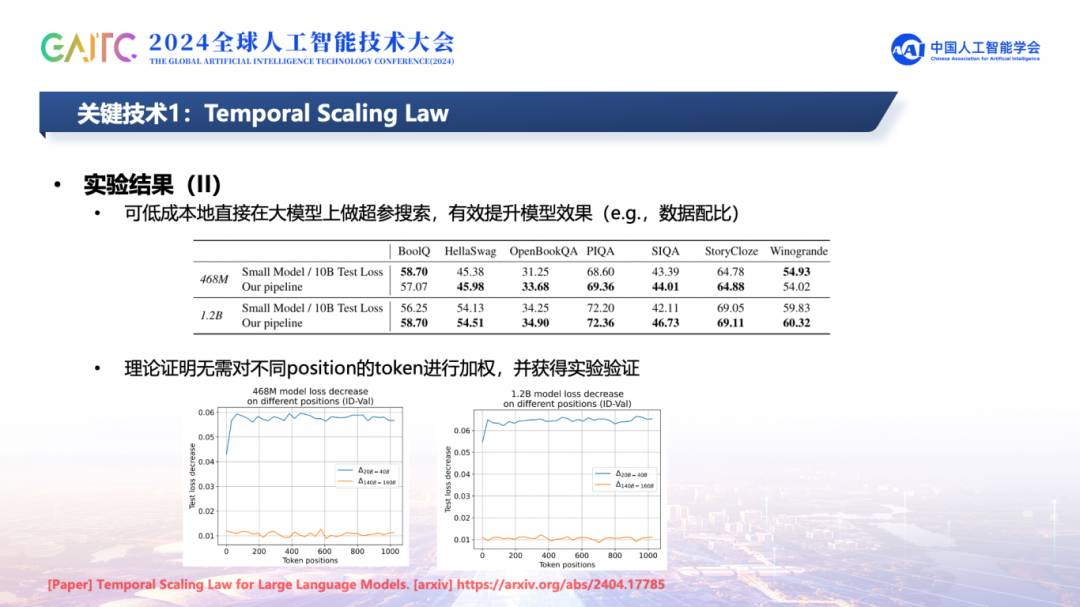

而在实际应用方面,Temporal Scaling Law可以以低成本方式,直接用于在大模型上进行更好的超参搜索。以数据配比为例,可结合小模型搜索先圈定若干较好的候选,进而用Temporal Scaling Law直接在目标大模型上做进一步的选择,而从实验结果来看,Temporal Scaling Law选择的最优方案比小模型搜索得到的最优方案,在绝大多数benchmark上均表现更佳。此外,Temporal Scaling Law也有助于我们洞察大模型训练的内在机制。通过Temporal Scaling Law的公式,可以推导出,随着模型训练达到一定程度,各个位置的token loss整体下降幅度将趋于相同,从实验的观察来看,不同参数规模的模型也确实呈现出理论推导的结果。这意味着,虽然不同位置的token loss本身在预测难度上存在天然差异,但实际上学习进度相似,无需做额外的加权,这也验证了大模型训练的默认设置(即 不对token位置进行加权)的有效性。

而在实际应用方面,Temporal Scaling Law可以以低成本方式,直接用于在大模型上进行更好的超参搜索。以数据配比为例,可结合小模型搜索先圈定若干较好的候选,进而用Temporal Scaling Law直接在目标大模型上做进一步的选择,而从实验结果来看,Temporal Scaling Law选择的最优方案比小模型搜索得到的最优方案,在绝大多数benchmark上均表现更佳。此外,Temporal Scaling Law也有助于我们洞察大模型训练的内在机制。通过Temporal Scaling Law的公式,可以推导出,随着模型训练达到一定程度,各个位置的token loss整体下降幅度将趋于相同,从实验的观察来看,不同参数规模的模型也确实呈现出理论推导的结果。这意味着,虽然不同位置的token loss本身在预测难度上存在天然差异,但实际上学习进度相似,无需做额外的加权,这也验证了大模型训练的默认设置(即 不对token位置进行加权)的有效性。

二、MiLe Loss:预训练损失函数优化方案

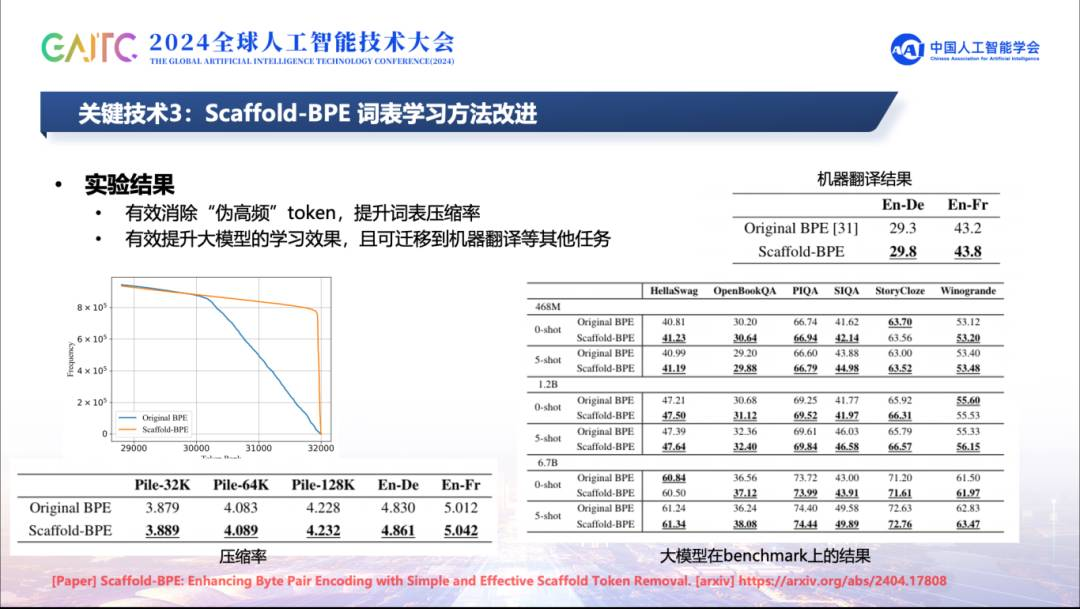

三、Scaffold-BPE:词表学习方法改进

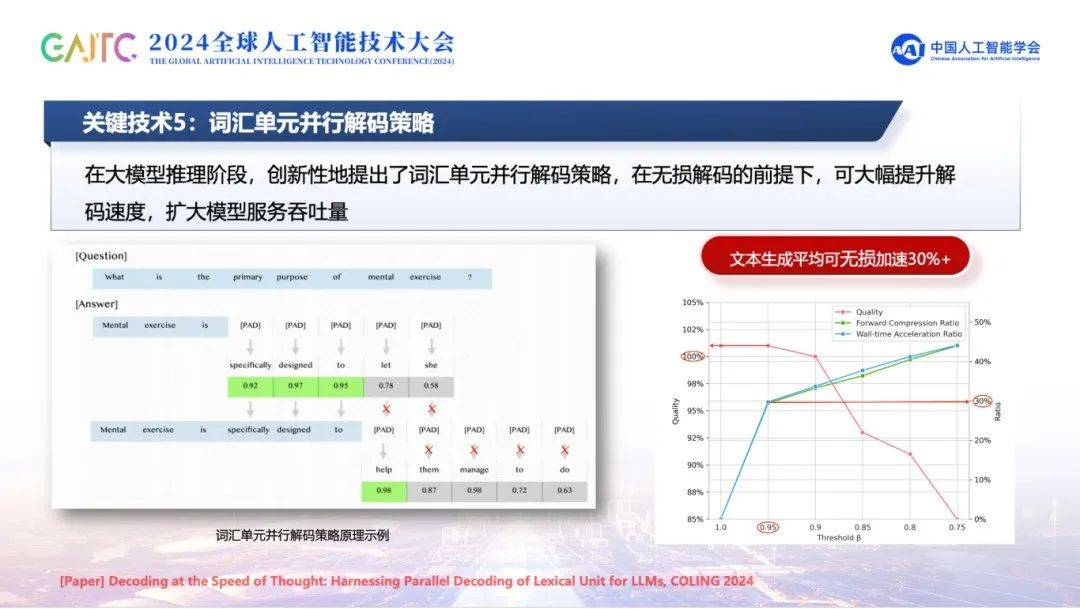

对齐之后,为了加速推理,「快意」大模型团队提出了词汇单元并行解码策略,在一次推理过程中,同时预测多个token,并自适应地选择其中置信度较低的部分,重新生成。经过实验,该方法可以在对解码效果无损的前提下,大幅提升解码速度约30%,有效扩大了模型服务的吞吐量。

在对齐阶段的强化学习中,Reward Model的质量对强化学习的效果有至关重要的影响。为了解决Reward Model在通用场景下判别能力不高、泛化能力较差的问题,「快意」大模型团队在Reward Model上引入了MoE(Mixture-of-Expert)结构,并通过实验验证了该方法能够显著提升Reward Model的判别、泛化和抗遗忘能力。在「快意」大模型中,Reward Model不仅仅用在RLHF(Reinforcement Learning from Human Feedback)中,也应用在了SFT阶段的数据质量筛选等环节,有效优化了对齐阶段的全流程。

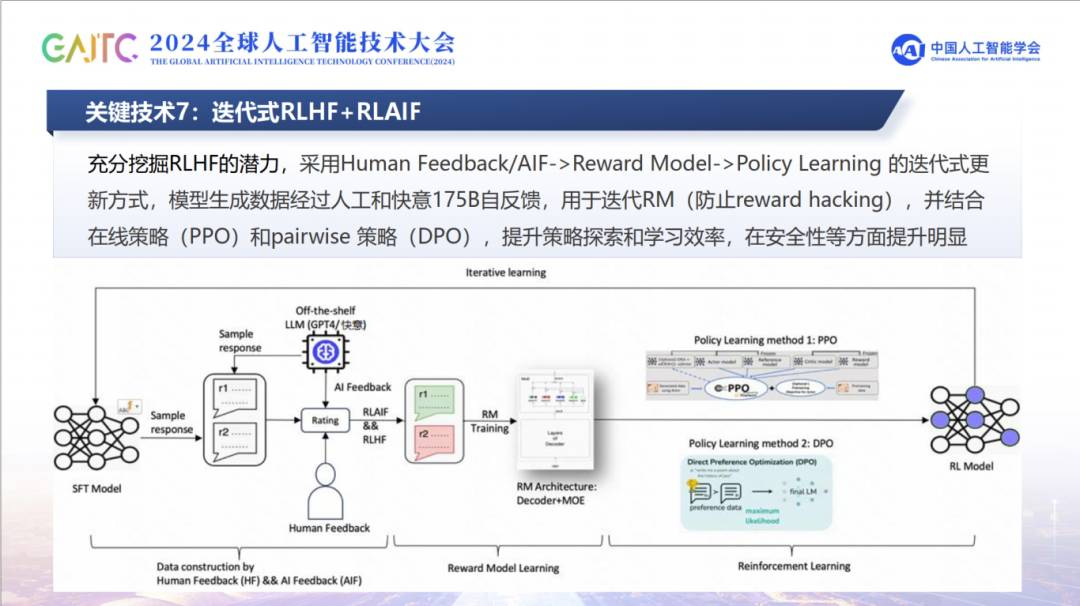

七、迭代式RLHF+RLAIF:提升策略探索和学习效率

在强化学习阶段,除了收集来自人类的反馈,「快意」大模型也收集了来自于「快意」175B、GPT-4等大模型的反馈,整合了RLHF和RLAIF,并且采用了RLHF+RLAIF->Reward Model->Policy Learning 的迭代式Pipeline来更新模型。在每一轮迭代中,人工反馈和大模型的反馈数据整合后,用于迭代Reward Model(防止reward hacking),进而用于指导PPO(Proximal Policy Optimization)和DPO(Direct Preference Optimization)的学习过程,提升强化学习策略探索和学习的效率。强化学习对「快意」大模型的安全性等方面带来了显著提升。

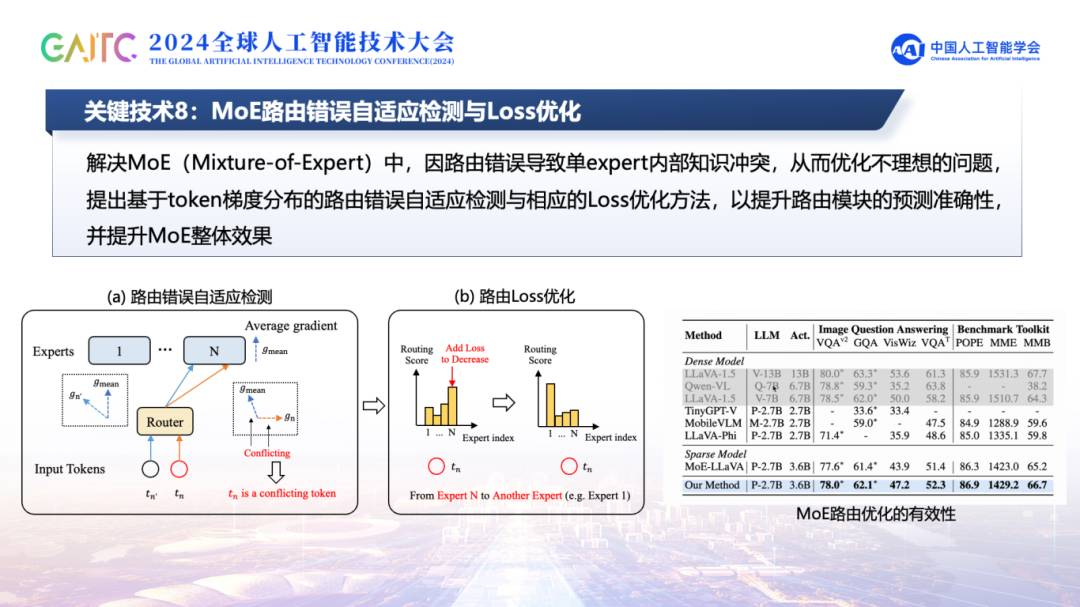

「快意」大模型近期也在升级MoE结构,在研发过程中,「快意」大模型团队发现路由错误,会引发单expert内部的知识产生冲突,加大学习难度,导致最终MoE优化效果不理想。为了提升路由模块预测的准确性和解决上述路由错误导致的expert优化不理想问题,「快意」大模型团队提出了基于训练过程中token梯度分布的自适应错误检测策略,并基于检测的结果,提出了新的路由loss优化方案,最终在多个benchmark的实验上,验证了该方法的有效性。

AI小快的挑战与破局

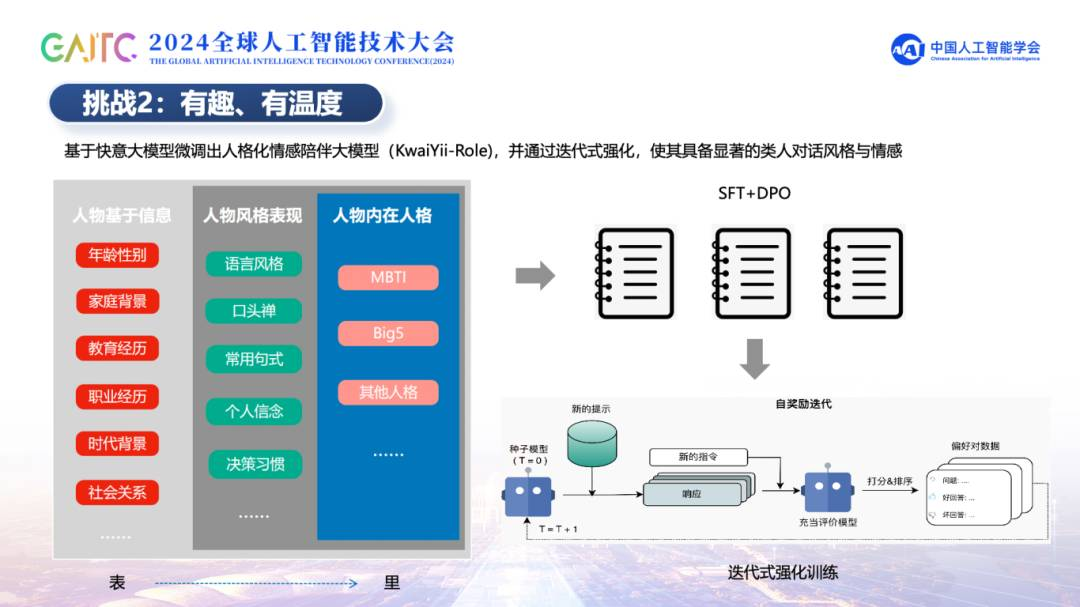

AI小快的核心定位是情感陪伴机器人,因此需要在人文关怀上表现优秀,要有趣,更要有温度。基于此,「快意」大模型团队,通过收集和构建大量的人物卡片信息,包括外在的年龄性别等特征,以及内在的人格特征等,在「快意」大模型上,微调出人格化的情感陪伴大模型(KwaiYii-Role),并基于对齐阶段的迭代式强化,让AI小快具备了显著的类人对话风格和情感表达能力。KwaiYii-Role的能力在权威评测榜单CharacterEval上也得到了充分验证,显著优于同赛道竞品,尤其在沟通技巧、表达多样性和共情能力等方面表现优秀。

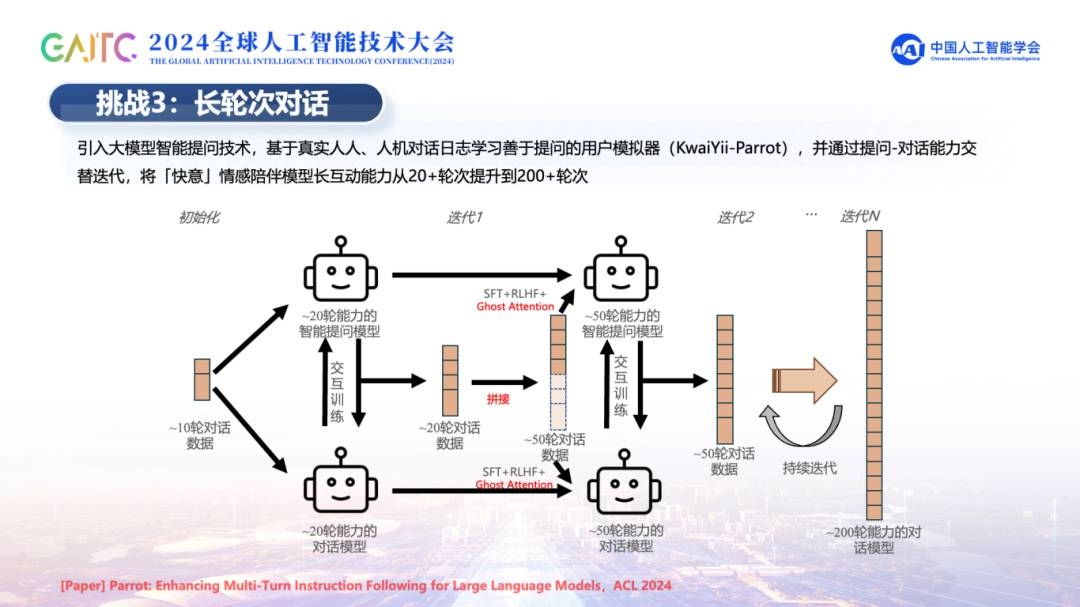

由于常见的对话训练语料,对话轮次在10次左右,很难直接用于训练AI小快使其具备超长轮次的对话能力。为此,「快意」大模型团队额外引入了智能提问的用户模拟器(KwaiYii-Parrot),并基于真实人人、人机对话日志对其进行训练,而后经过用户模拟器与AI小快的多轮交互,累计越来越长的对话日志,并通过数据清洗、增强等方式,同时更新用户模拟器与AI小快,逐步提升其对话轮次。最终,AI小快具备了与用户进行超过200轮对话的能力。

得益于快手公司在内容、场景、基建等方面的优势,以及对大模型研发的大力投入,快手「快意」大模型以较短的周期,顺利完成从13B到175B的规模提升和能力升级,同时也在AI小快等多个应用场景中验证了业务价值,打开了大模型落地应用的新局面。未来,「快意」大模型团队,将持续围绕大模型技术创新、应用创新等方面,继续攻关迭代,推动「快意」大模型走向新的高度。

文章来源:快手大模型与多媒体技术部

快手大模型与多媒体技术部,专注于快手大模型及应用的研发。凭借深厚的技术积淀,全面构建了快手大模型能力矩阵,涵盖语言、视觉、音频及多模态技术,并深度结合多元业务场景,如内容理解、短视频/直播创作、社交互动、商业化AIGC等,应用前景广阔。快手大模型与多媒体技术部、AI Platform,诚邀你加入!

在这里你可以获得:

-

参与大模型核心研发和应用,见证和推动技术变革

-

为亿万用户带来精彩纷呈的智能体验

-

和行业算法专家并肩作战

我们期待你的加入!请发简历到:

dongbinbin@kuaishou.com